如何高效管理多个 AI 模型?试试 Cherry Studio

在 AI 时代,面对 OpenAI、Claude、Gemini 以及各种国产大模型,很多用户会陷入一个困境:为了使用不同的模型,必须在多个网页标签页或 App 之间频繁切换,且对话记录分散,难以统一管理。如果你正需要一个能将所有 AI 能力集成在一起,且注重隐私安全的本地客户端,Cherry Studio 是一个理想的选择。

Cherry Studio 是一款跨平台的 AI 对话客户端,全面覆盖 Windows、Mac 和 Linux 系统(移动端计划中)。它不仅能无缝集成主流的 LLM 云服务商,还支持通过 Ollama 部署本地模型。无论是处理复杂文档、生成代码、AI 绘图还是专业翻译,用户都可以在一个统一的界面中完成,无需在不同平台间跳跃。

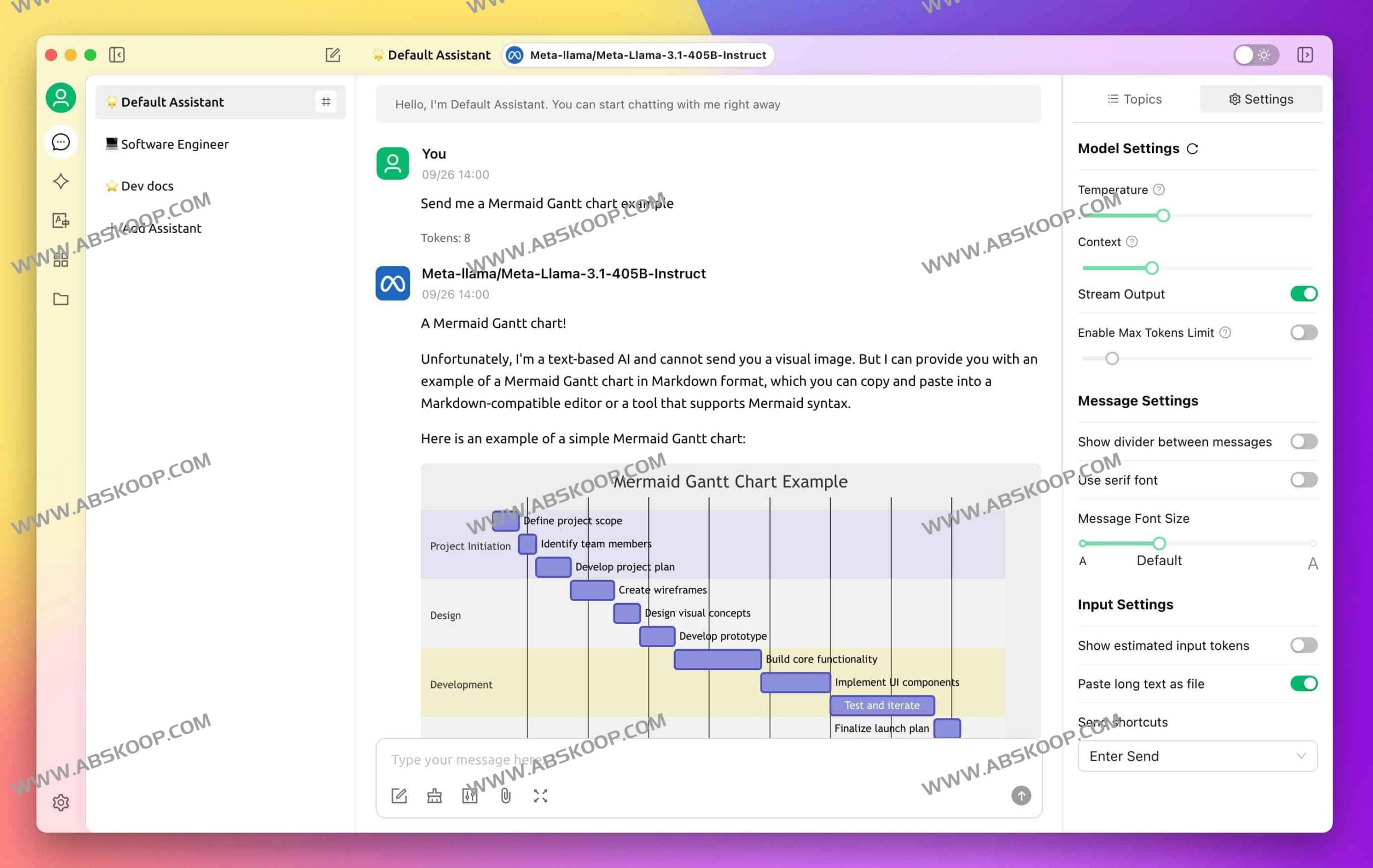

界面预览

核心功能特性

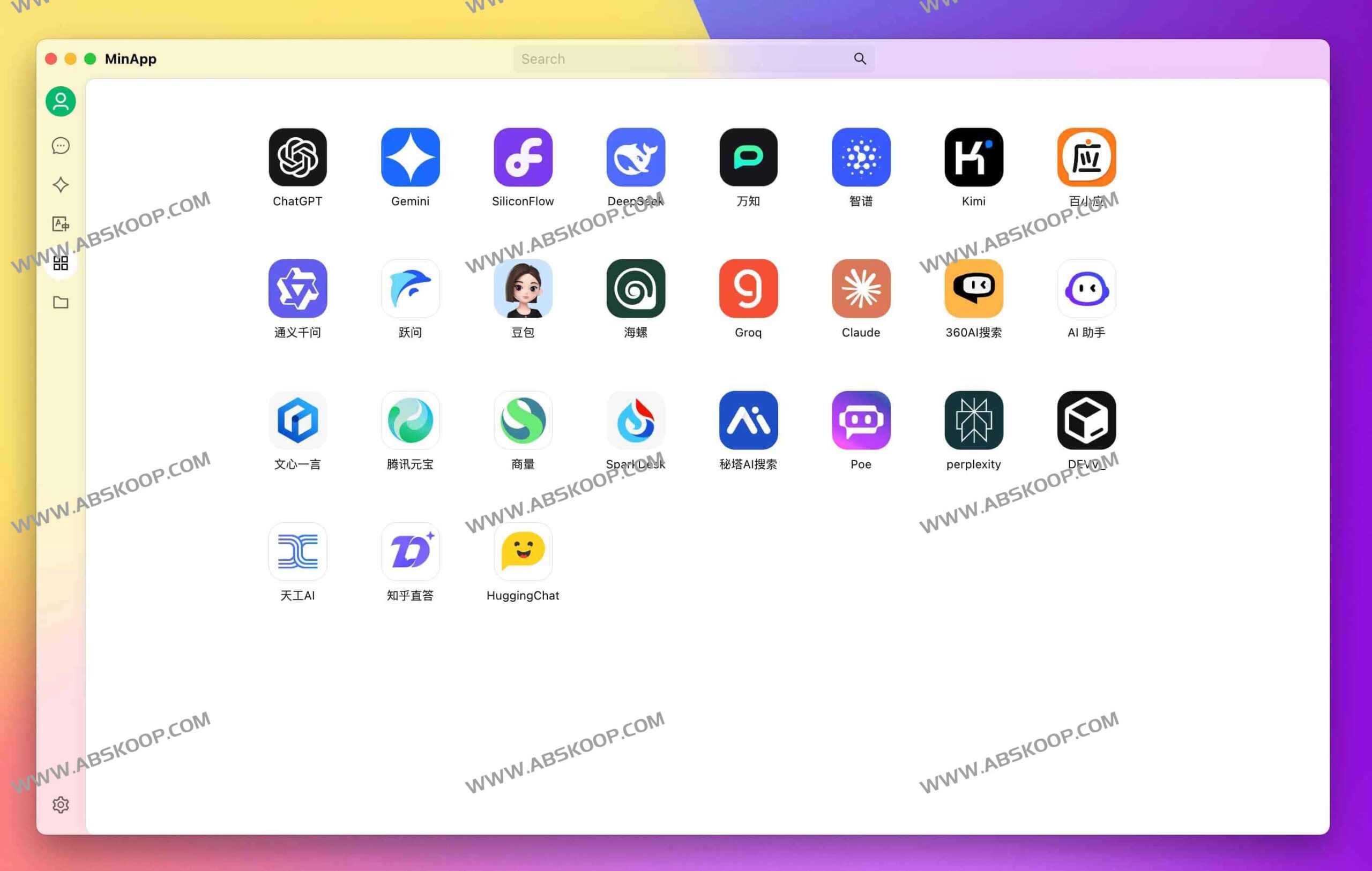

- 全方位的模型生态支持

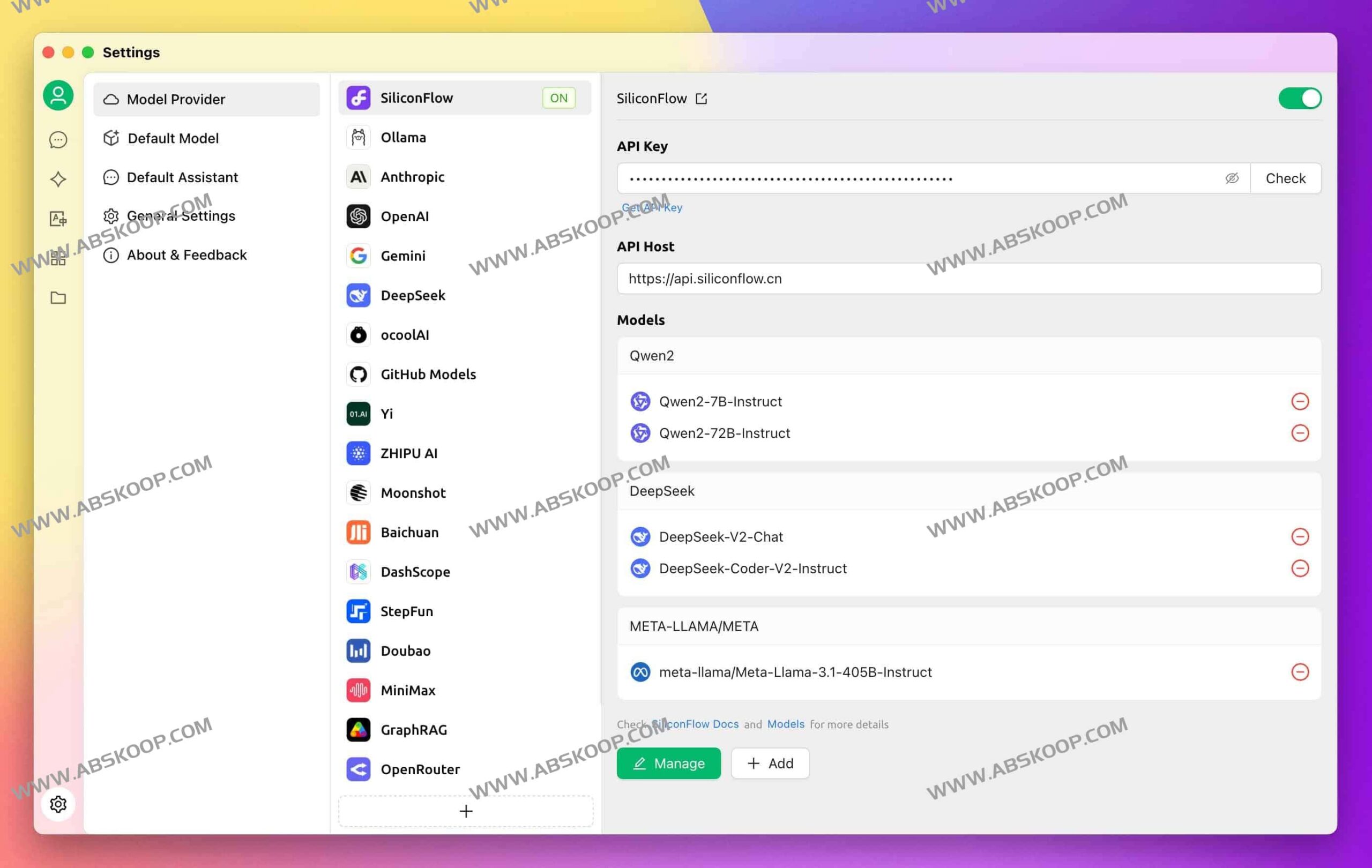

- 云端服务:深度集成 OpenAI、Gemini、Anthropic 及硅基流动等主流 API。

- Web 服务:支持 Claude、Perplexity、Poe、腾讯元宝、知乎直答等。

- 本地部署:完美适配 Ollama,让模型在本地运行,保障极致隐私。

- 灵活的助手管理与对话

- 内置 300 多个预设 AI 助手,覆盖多种应用场景。

- 支持自定义创建专属助手,打造个性化工作流。

- 支持 多模型并行对话,可快速对比不同模型的回答质量。

- 强大的数据处理能力

- 支持 PDF、Office 及图片等多种格式的文档处理。

- 集成 Mermaid 图表可视化与代码高亮,让输出结果更直观。

- 通过 WebDAV 实现文件管理与云端备份。

- 细节至上的用户体验

- 高效工具:配备全局搜索、话题管理系统、AI 翻译及拖拽排序等功能。

- 视觉定制:支持明暗主题切换、透明窗口及完整的 Markdown 渲染。

- 便捷部署:开箱即用,无需复杂环境配置,支持快速内容分享。

适用场景

Cherry Studio 非常适合需要 对比模型输出结果 的开发者、需要 构建个人知识库 的研究员,以及希望在 一个界面管理所有 AI 订阅 的效率追求者。由于所有数据存储在本地,它也非常适合对数据隐私有高要求的企业或个人用户。

下载与安装

你可以通过以下渠道获取 Cherry Studio:

- 官方网站:https://cherry-ai.com/

- GitHub 开源仓库:https://github.com/CherryHQ/cherry-studio

- 快速下载(夸克网盘):点击跳转

正文完