打破 AI 的“网页围墙”

虽然 ChatGPT 和 Claude 极其强大,但它们通常被局限在浏览器或官方 App 中。如果你希望在 微信、飞书或 Telegram中直接调用这些模型,或者需要 AI 具备跨平台的“长期记忆”,传统的 API 对接开发成本极高。

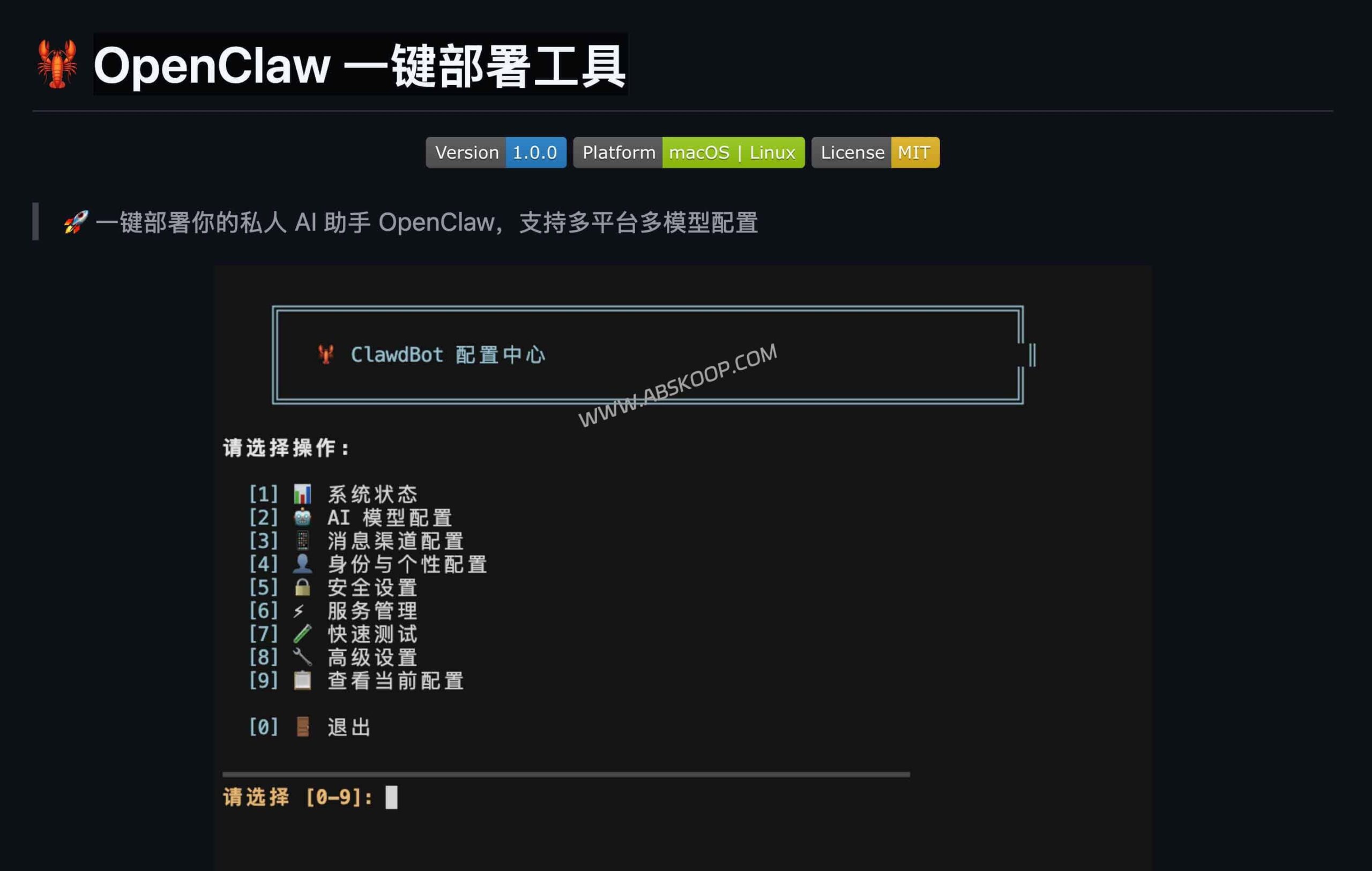

GitHub 开源项目 OpenClaw 提供了一套高效的解决方案,旨在帮助用户快速构建一个 多模型聚合、具备记忆能力且跨平台 的私人 AI 助手。

什么是 OpenClaw?

简单来说,OpenClaw 是一个 AI 智能网关(超级中间件)。它将强大的模型能力与你常用的社交软件连接起来,充当了“大脑”与“接口”之间的桥梁:

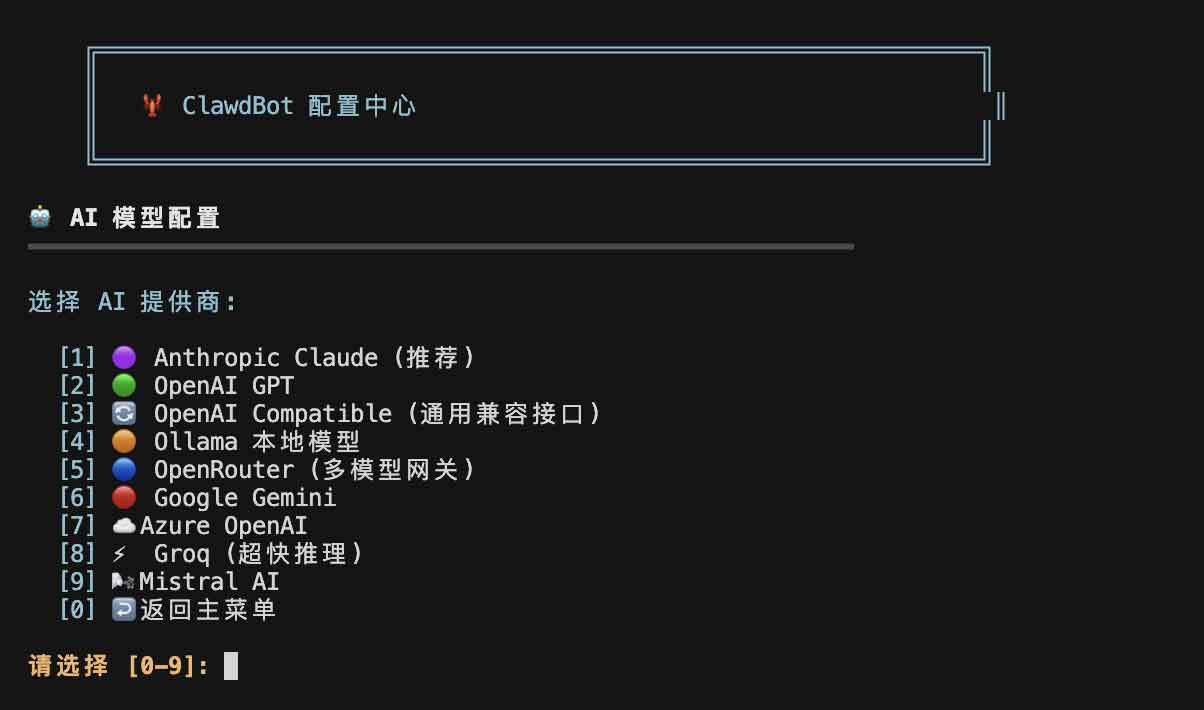

- 模型端(大脑): 兼容 OpenAI、Claude、Gemini 等主流云端模型,同时支持通过 Ollama 接入本地运行的 Llama 3 或 DeepSeek。

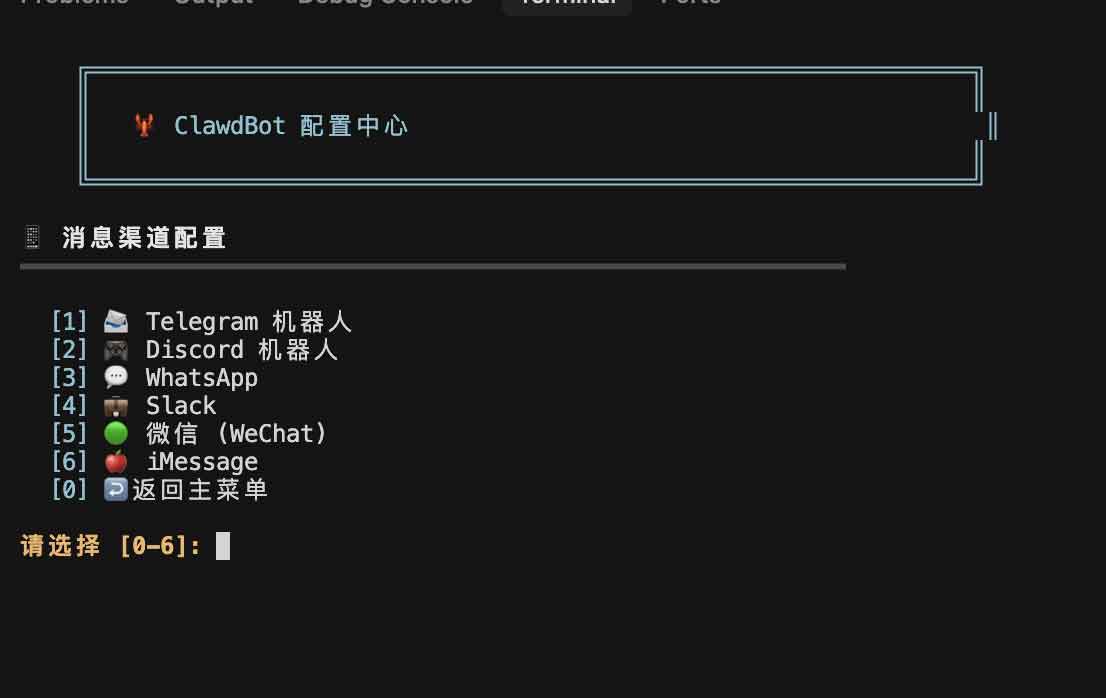

- 应用端(嘴巴): 深度集成 Telegram、Discord、Slack、微信 (WeChat) 及飞书 (Feishu) 等主流通讯工具。

部署完成后,你无需在多个网页间切换,即可在微信中向 Claude 咨询,或在 Telegram 中让 GPT-4 编写代码,且所有对话上下文均能得到妥善保存。

核心功能亮点

1. 跨平台的持久化记忆

不同于大多数“阅后即焚”的简单 Bot,OpenClaw 支持数据持久化存储。这意味着你在 Telegram 上讨论的技术方案,切换到微信后依然可以无缝衔接,AI 能记得之前的沟通细节,极大提升了连续性工作的效率。

2. 从“问答机”升级为“自动化助手”

OpenClaw 不仅能被动回答问题,还支持 主动推送。你可以配置定时任务(如每日早晨推送新闻摘要),或将其与服务器监控系统联动,在触发报警时第一时间向你发送提醒。

3. 极简的部署流程

为了降低技术门槛,项目提供了 OpenClawInstaller 一键安装脚本。无需手动配置复杂的 Python 环境或 Docker 镜像,仅需一行命令即可完成环境检测、Node.js 安装及服务启动:

curl -fsSL https://raw.githubusercontent.com/miaoxworld/OpenClawInstaller/main/install.sh | bash⚠️ 安全部署建议

- 优先使用官方 API: 建议通过企业协作平台的官方 Webhook 或 Bot 开放能力接入,以降低账号封禁风险。

- 保障网络稳定性: 确保服务器与模型 API 之间有稳定的连通性;企业级部署建议增加网关层进行鉴权与限流。

- 权限隔离: 若开启命令执行等高级功能,务必在独立容器或虚拟机中运行,并为 API Key 严格设置额度上限。

资源链接

⚠️ 免责声明: 本项目涉及第三方平台接入,请务必遵守各平台的使用协议。因违规操作导致的账号风险由用户自行承担。