Auto-Subs 是一款将 OpenAI Whisper 模型深度集成到 DaVinci Resolve 的开源插件,它让创作者能够利用本地显卡算力,在剪辑软件内直接生成高精度字幕,彻底摆脱昂贵的 SaaS 订阅费与繁琐的导出导入流程。

为什么它是达芬奇用户的理想选择?

对于依赖达芬奇(DaVinci Resolve)的独立创作者而言,字幕制作往往是工作流中最碎片化的环节。传统的方案通常在两难之间徘徊:要么使用剪映等工具实现快速识别,但面对复杂的无损回传至达芬奇时,流程冗长且易出错;要么支付 Otter 或 Descript 等昂贵的月费,不仅面临时长限制,还需承担数据上传至云端的隐私风险。

Auto-Subs 则提供了一种“极客式”的解法:

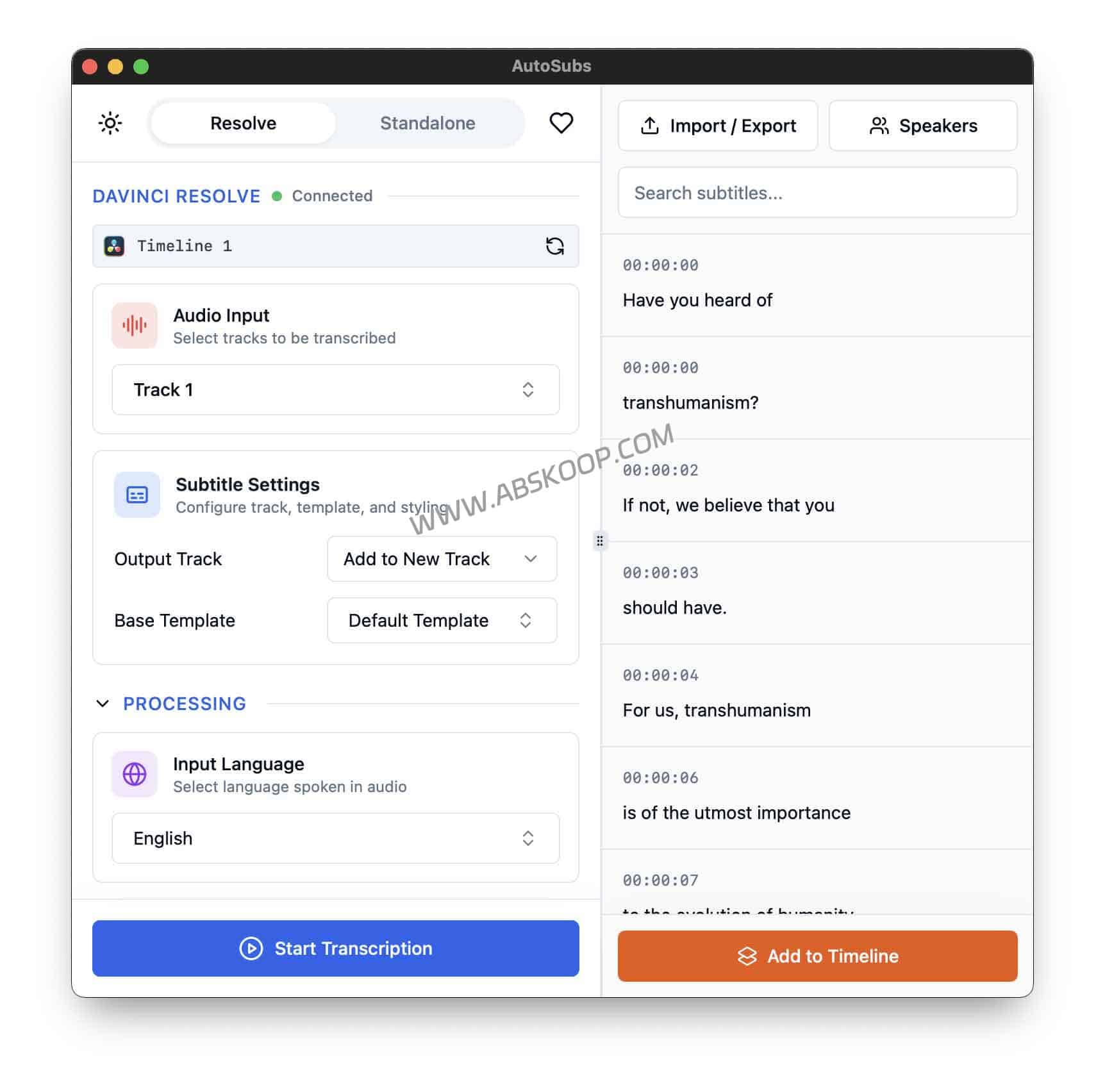

- 原生工作流集成: 它并非简单的 SRT 文件生成器,而是作为脚本插件直接嵌入达芬奇。用户只需在软件内点击生成,字幕便会自动对齐时间轴,无需手动拖拽,极大地提升了剪辑节奏。

- 绝对的隐私掌控: 采用完全离线(On-Device)运行机制。从语音识别到文字生成,所有数据均在本地显卡处理,无需经过第三方云端服务器,是处理敏感访谈或内部素材的最稳妥方案。

- 算力价值最大化: 既然已经为视频剪辑配置了高性能显卡,与其购买云端算力,不如直接调用本地硬件,实现零成本、不限时长的自由创作。

性能实测与语言支持

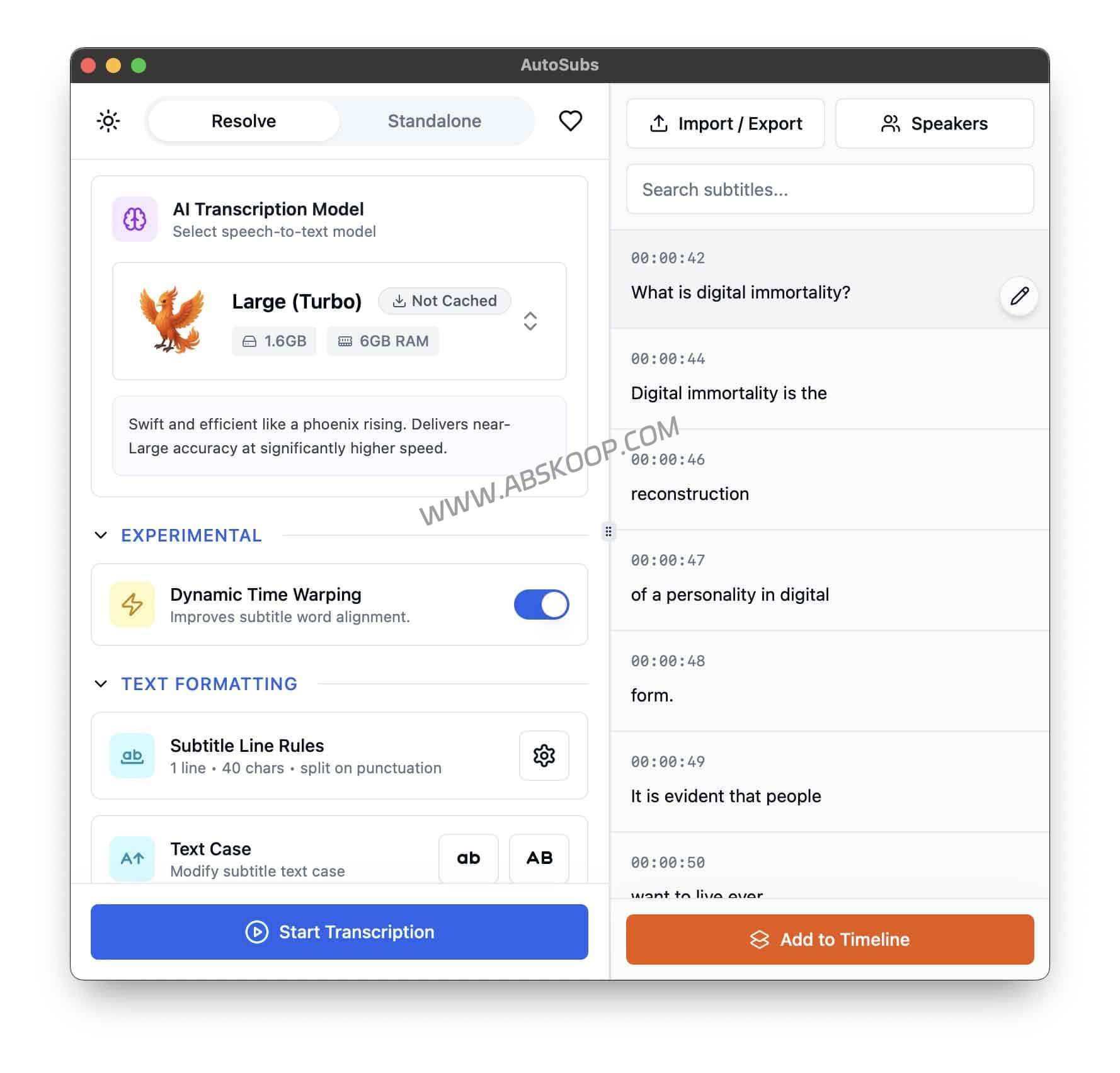

Auto-Subs 依托于开源界顶尖的 Whisper 模型,在识别准确率上处于第一梯队。在实际测试中,使用 RTX 3060 显卡处理一段 10 分钟的 1080P 视频,生成字幕仅需 40-60 秒 。

在多语言处理方面,它支持包括中、英、日、韩在内的 90 多种语言,甚至具备将外语语音直接转译为英文字幕的功能。

快速上手指南

部署过程无需深厚的编程基础,按照以下步骤即可完成安装:

- 下载安装: 前往 GitHub Releases 页面下载对应操作系统的安装包(支持 Windows、macOS、Linux)。其中 Apple Silicon (M1/M2) 芯片已获得专项优化,运行效率极高。

- 选择运行模式:

- 独立模式 (Standalone): 适用于非达芬奇用户,支持直接导入视频并导出 SRT/VTT 文件。

- 达芬奇模式 (Resolve Mode): (推荐) 安装后在

Workspace → Scripts菜单中调用。选中时间轴音频后一键生成。

💡 硬件建议与注意事项:

建议配置 NVIDIA 显卡(显存 4GB 及以上)。在模型选择上,初次运行建议选择 “Small” 或 “Medium”,这在速度与精度之间达到了最佳平衡;“Large”模型虽然最精准,但对显存要求较高且处理速度明显下降。

总结

在 AI 工具层出不穷的今天,Auto-Subs 摒弃了复杂的 API 套壳包装,回归到解决实际生产力问题的本质。它让创作者重新掌控数据的所有权,将昂贵的订阅开销转化为一次性的硬件投资。只要你拥有足够的本地算力,这就是目前最高效、最经济的字幕解决方案。

项目资源

- GitHub 项目地址: https://github.com/tmoroney/auto-subs

- 官方文档指南: https://tom-moroney.com/auto-subs/

* 声明:本文介绍的是一款基于开源协议(MIT License)的本地 AI 效率工具,旨在利用本地算力提升创作生产力。软件本身不包含任何破解、绕过版权验证的功能。请在遵守当地法律法规及相关平台服务协议的前提下合法使用。