AI 绘画全能实战课:Midjourney 与 Stable Diffusion 详解

本课程旨在为学习者提供一套完整的 AI 绘画技术链路,深度解析 Midjourney (MJ) 与 Stable Diffusion (SD) 两大顶流工具。内容涵盖从零起步的环境搭建、账号配置,到高阶的脚本自动化处理,通过对 Prompt 设计、参数调优及模型训练的系统讲解,帮助用户实现从静态图像到动态视频的高质量输出。

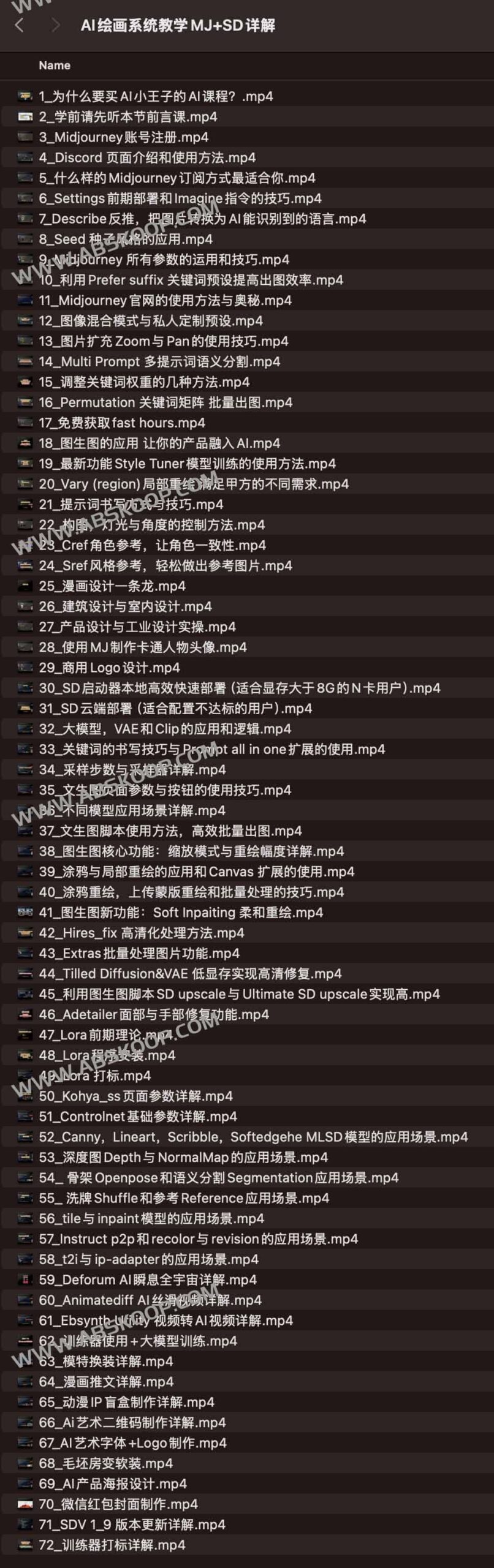

核心课程大纲

1. 基础起步与环境部署

- 账号与环境: Midjourney 账号申请、Discord 界面操作指南,以及 Stable Diffusion 的本地部署与云端安装。

- 核心机制: 详解 Imagine 指令、Describe 反推、Seed 种子值,以及采样步数、采样器等关键参数的实操应用。

2. Prompt 进阶与自动化出图

- 提示词工程: 掌握 Prompt 书写技巧、Permutation 关键词矩阵以及多提示词的语义分割方法。

- 高效工作流: 文生图脚本应用、Extras 批量处理,以及利用 SD upscale 与 Ultimate SD upscale 实现高质量图像放大。

3. 图像精修与自定义创作

- 扩展与重绘: 运用 Zoom 与 Pan 进行画布扩充,利用 Soft Inpainting 实现柔和重绘,通过 Hires_fix 和 Tiled Diffusion 提升图像分辨率。

- 参考与定制: 深度解析 Cref(角色参考)与 Sref(风格参考),覆盖漫画、建筑、产品设计等全流程实战。

4. 高阶模块与动态生成

- 精准控制 (ControlNet): 熟练运用 Canny、Lineart、Depth、Openpose 等模型实现精准构图。

- 模型训练 (LoRA): 涵盖 LoRA 理论、安装、打标流程及 Kohya_ss 参数调优。

- 动态视频: 掌握 Deforum 宇宙视角、Animatediff 丝滑动画以及 Ebsynth 视频转 AI 的核心技术。

适用场景

- 零基础初学者: 快速搭建环境,掌握 AI 绘画基础逻辑。

- 商业设计师: 利用 Cref/Sref 和 ControlNet 确保角色一致性与场景还原度。

- 内容创作者: 通过 Animatediff 和 Deforum 制作 AI 短视频与动态艺术作品。

学习收益

完成本课程后,你将能够独立部署 AI 绘画环境,灵活运用 Prompt 矩阵高效出图。通过掌握 LoRA 训练与 ControlNet 精准控制,你可以在保持艺术风格一致性的前提下,实现对图像细节的绝对掌控,将创作效率提升至工业级水平。

资源获取方式

下载地址: 点击通过夸克网盘下载

正文完