制作 AI 视频最令人沮丧的往往不是单次生成失败,而是碎片化的生产流程:剧本在文档里,角色设定在提示词中,关键帧散落在文件夹内,导致镜头衔接极不流畅。

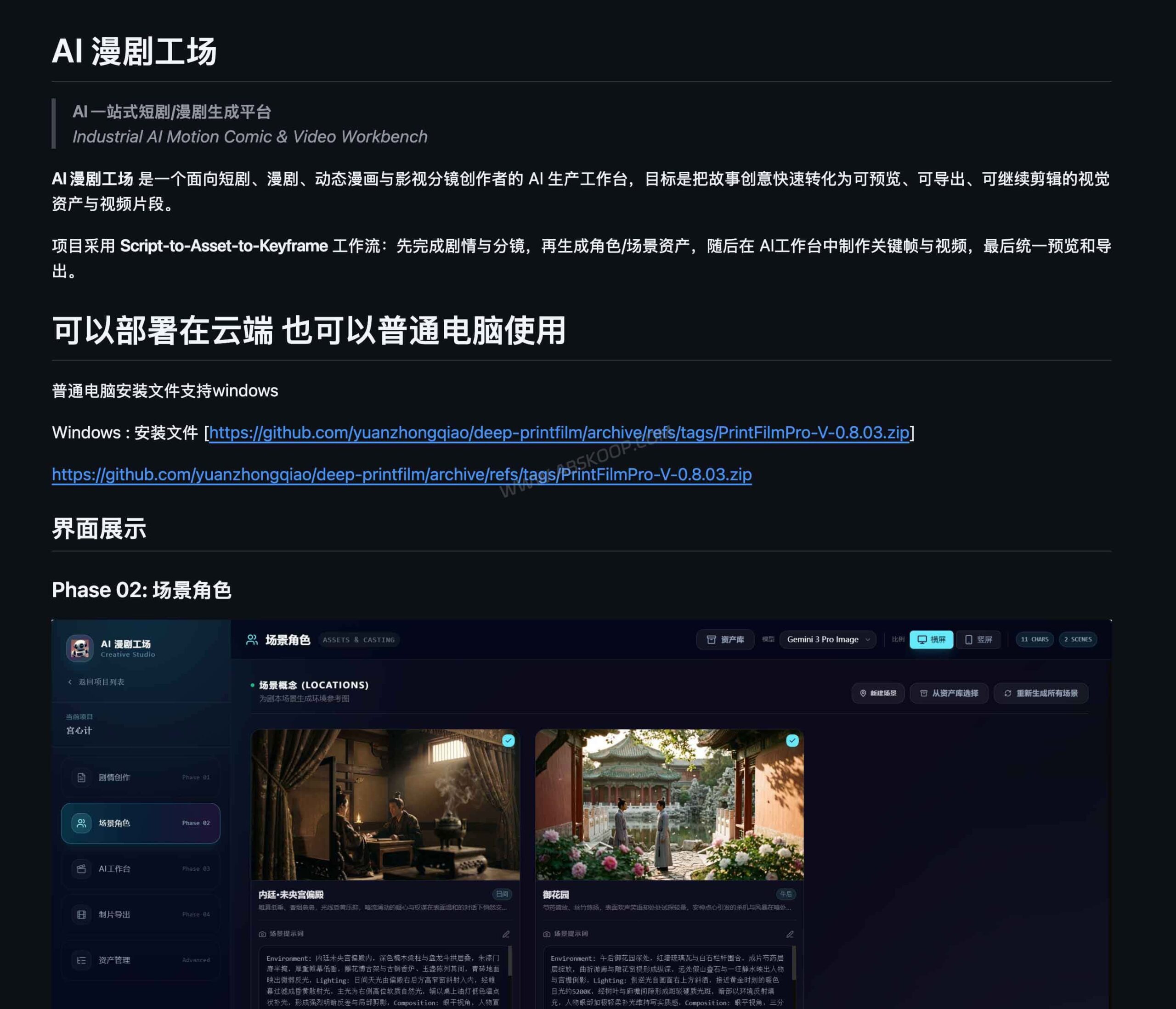

deep-printfilm(AI 漫剧工场)旨在终结这种混乱。它并非简单的“一键生成”工具,而是一个面向 AI 短剧、动态漫画及影视分镜的 本地可视化工作台,将剧本、角色、场景、关键帧与视频片段整合在统一的流程管理之下。

该工具的核心价值在于提供一套可控的工作流,而非替代底层的视频大模型。对于那些深受提示词管理混乱、角色一致性差而困扰的创作者来说,这是一个极具实用价值的项目。

解决 AI 视频的痛点:从“散装”到“流水线”

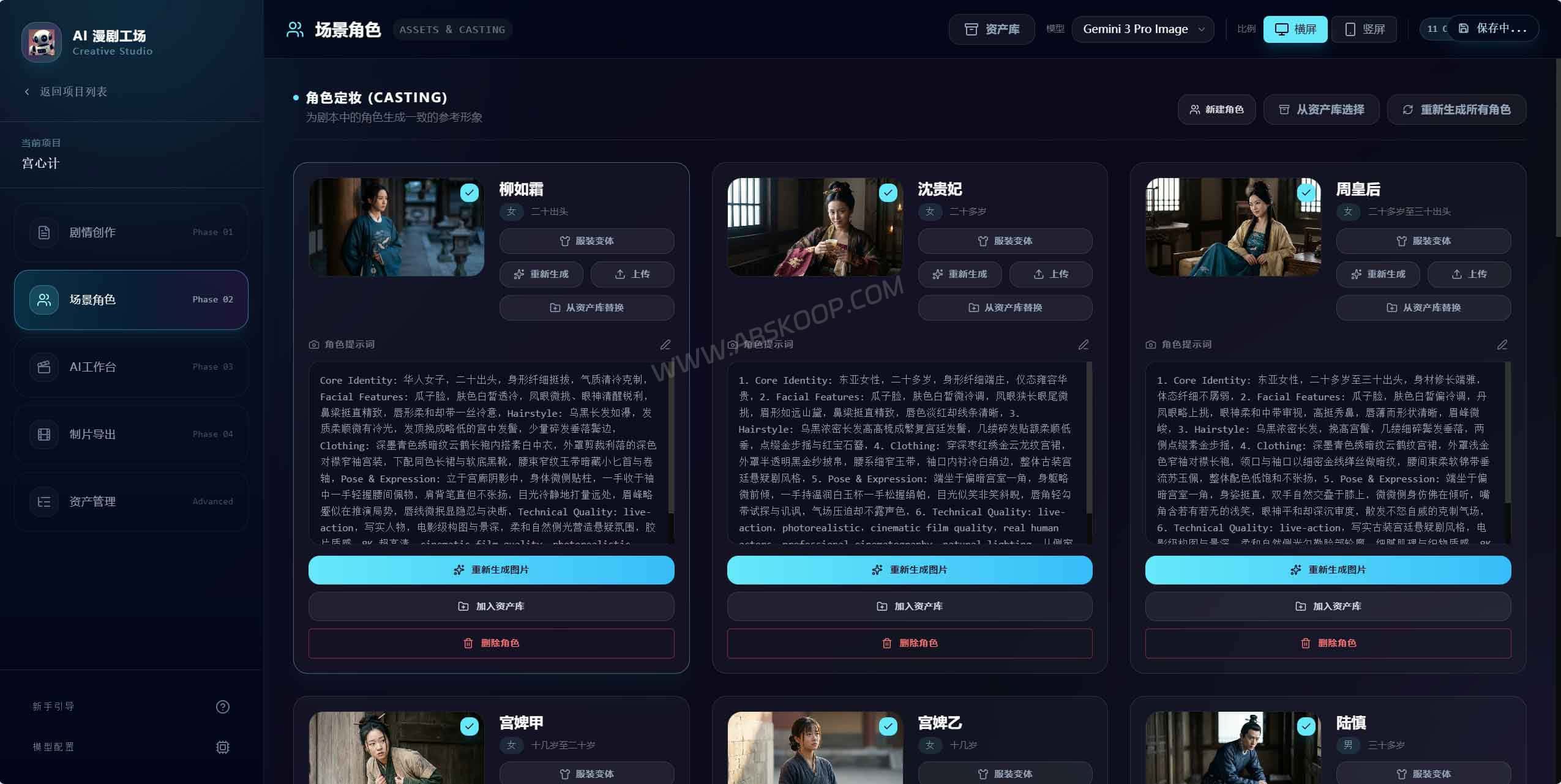

在传统的 AI 视频制作中,资产管理高度依赖记忆。由于缺乏统一参考,经常出现主角服装在镜头间随意切换的 Bug,创作者不得不频繁地在不同工具间复制粘贴提示词进行修正。

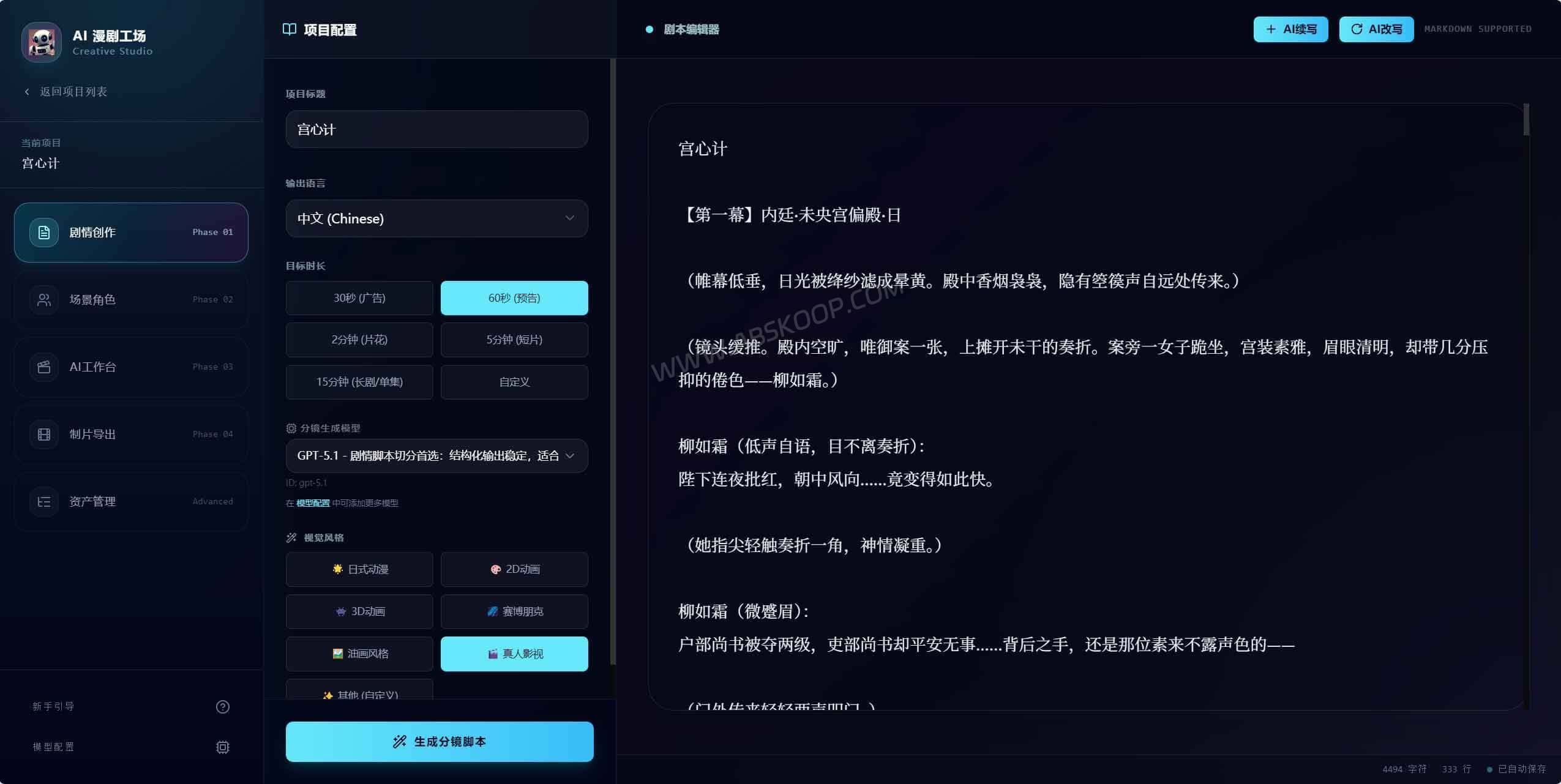

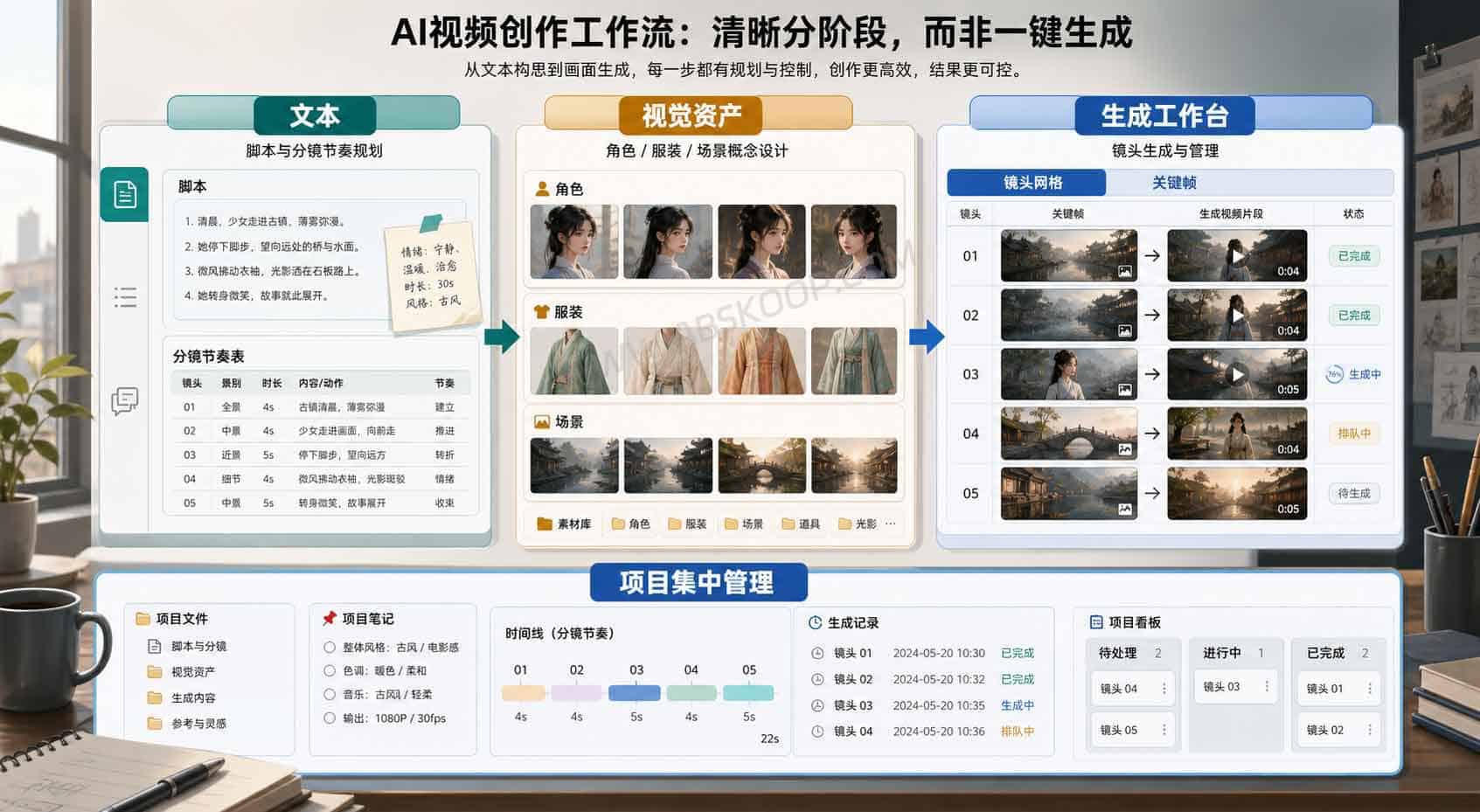

deep-printfilm 引入了 Script-to-Asset-to-Keyframe(剧本 $rightarrow$ 资产 $rightarrow$ 关键帧)的逻辑,将生产过程标准化:

- 剧本拆解: 输入故事大纲并将其细化为具体分镜。

- 资产定型: 生成角色的基础定妆照及多种服装变体,确立视觉基准。

- 受控生成: 在生成视频片段时,强制模型参考既有的视觉资产,确保前后剧情不脱节。

核心工作流:如何串联生产环节

deep-printfilm 摒弃了“一键出片”的噱头,将工作流切分为三个清晰的阶段:

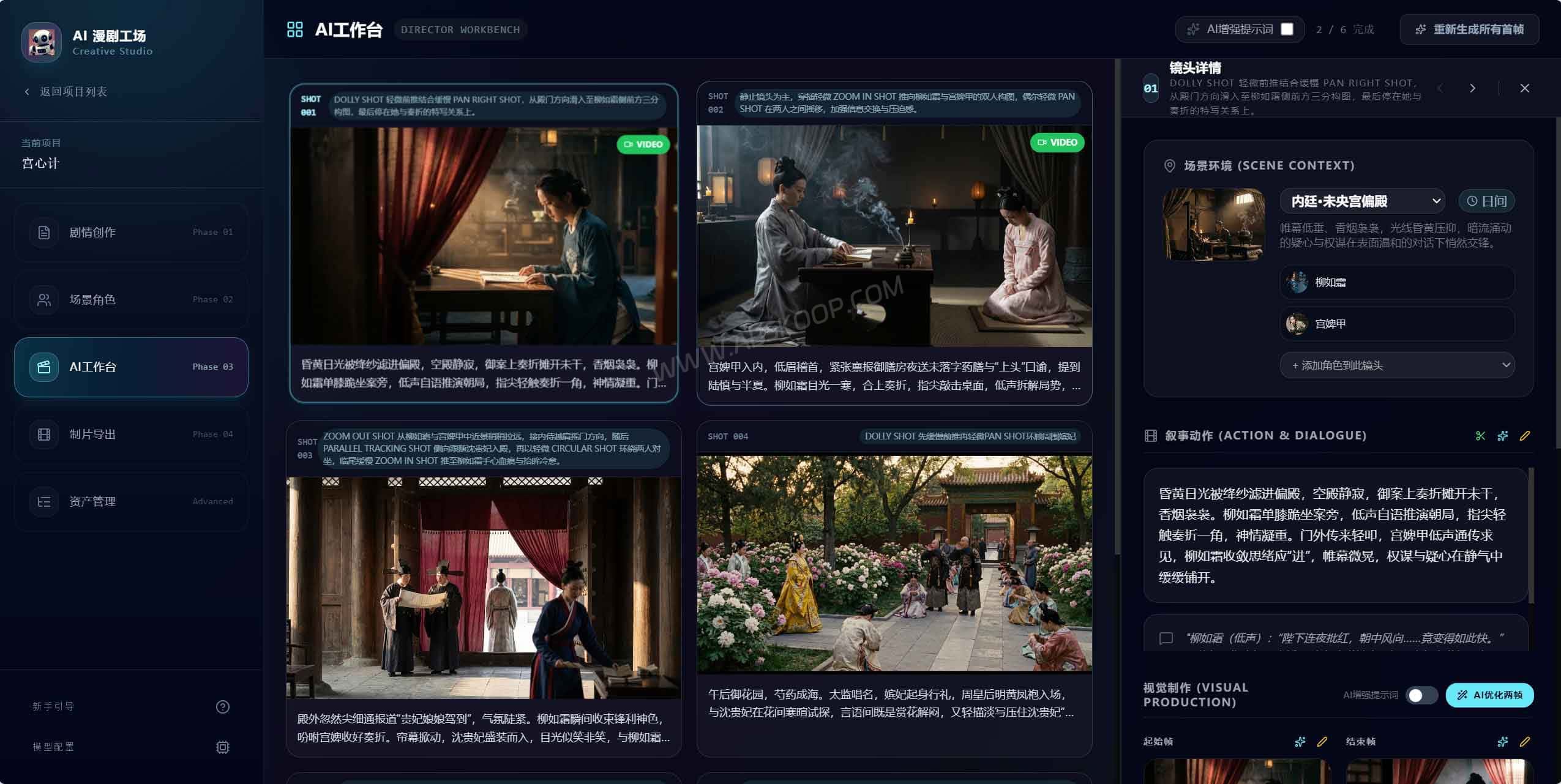

首先是 文本层 (把控剧本与分镜节奏),其次是 资产层 (确立角色、服装与环境概念图),最后进入 生成工作台。在核心操作区,所有镜头以网格形式呈现,用户可为每个镜头创建起始关键帧,并基于此跑通视频。

这种结构将原本散落在记事本、文件夹和历史记录中的素材集中化,极大地提升了项目管理效率。

部署方式与关键注意事项

目前该项目在 GitHub 上关注度较高,已发布正式 Release 版本。用户可以通过以下两种方式部署:

- 快捷安装: 使用开发者提供的基于 Electron 打包的 Windows 桌面端。

- 进阶部署: 支持 Docker 服务端部署,适用于服务器、NAS 或本地开发环境。

- API 成本:“本地部署”仅指工作台软件,文本、图像和视频生成仍依赖第三方 API(兼容 OpenAI/GitCC 格式),需自行承担接口费用。

- 数据备份: 项目数据存储在浏览器的 IndexedDB 中。请勿随意清理浏览器缓存或站点数据,否则会导致项目内容丢失。

- 版权合规: 使用受版权保护的 IP 进行商业化创作时,请务必核对模型服务商的使用条款。

适用场景分析

✅ 推荐人群:已经尝试过 AI 视频生成,但受够了频繁切换窗口、素材管理混乱,需要提升生产效率的创作者。

❌ 不推荐人群:完全没有 API 调用经验,期待安装后点击一个按钮就能自动生成完整短剧的纯新手。

建议用户先尝试跑通一个几十秒的短片,验证其工作流是否契合自己的创作习惯,再决定是否将其作为主力生产工具。

Jellyfish 评测:开源 AI 短剧工作流,想解决人物漂移和流程割裂

项目主页与源码入口

免责声明:本文结合项目公开页面与文档整理,更偏向选型判断。本站不提供未授权 API 调用引导。虽然该 GitHub 公开仓库在说明中提及 MIT 授权,但目前未见独立许可文件,具体商用、二次分发及生成的 AI 内容版权边界,请务必以项目实际授权情况和第三方模型服务商的使用条款为准。