在进行 AI 模型训练或 GPU 服务器运维时,最令人头疼的场景莫过于:显存被莫名占用,却找不到哪个进程在作祟。面对死循环任务或僵尸进程,传统的处理流程极其繁琐——先通过 nvidia-smi 检索 PID,再手动执行 kill 命令。在多用户共享的实验室或公司服务器上,这种操作不仅低效,还潜藏着误杀他人训练任务的风险。

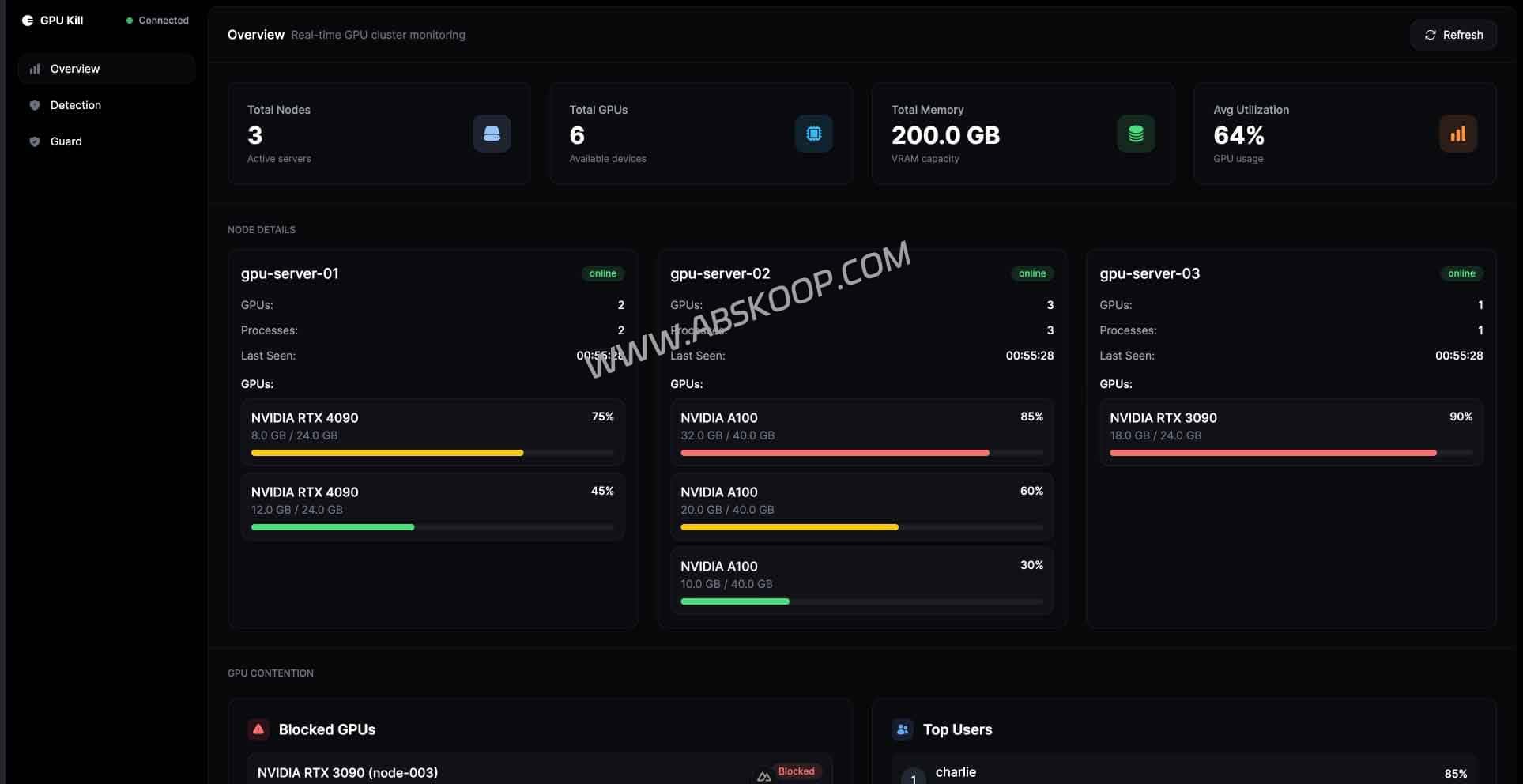

为了解决这一痛点,GPU Kill 应运而生。它并非简单的监控工具,而是一把面向算力管理者的“瑞士军刀”,旨在通过一套统一的指令集,实现跨平台的 GPU 资源调度与快速清理。

核心能力:为什么它能提升运维效率?

GPU Kill 的核心逻辑在于打破硬件厂商的壁垒,将碎片化的管理命令“大一统”。

1. 真正意义上的跨平台管理

以往在不同设备上,我们需要切换不同的工具:Mac 使用 Activity Monitor,Linux 依赖 nvidia-smi。而 GPU Kill 统一了 NVIDIA、AMD 以及 Apple Silicon (M 系列) 的管理接口。无论是在 Linux 服务器还是 Mac 开发机上,你只需运行 gpukill 即可同步获取显存占用、温度及功耗等关键指标。

2. 快速定位“资源刺客”

针对实验室中常见的未授权任务或异常高负载进程,该工具提供了审计模式 (--audit)。它能通过扫描计算特征,快速识别出那些占用资源却不产生有效产出的“幽灵进程”,让资源滥用无所遁形。

3. 前瞻性的 AI 运维集成 (MCP)

这是该工具最前卫的特性:内置了 MCP (Model Context Protocol) 服务。通过将 GPU Kill 连接至 Claude Desktop 等 AI 客户端,你可以直接使用自然语言下达指令,例如:“检查 GPU 0 的卡死原因,并清理掉占用最高的非系统进程。” AI 将自动调用工具完成定位与执行,将运维门槛降至最低。

工具对比:GPU Kill vs 传统方案

| 工具 | 支持平台 | 核心能力 | 评价 |

|---|---|---|---|

| GPU Kill | NVIDIA / AMD / Mac | 监控 + 快速清理 + AI 交互 | ⭐⭐⭐⭐⭐ |

| nvidia-smi | 仅 NVIDIA | 基础状态查询 | ⭐⭐⭐ |

| nvtop | 多平台 | 可视化监控(侧重于观察) | ⭐⭐⭐⭐ |

快速上手指南

🚀 安装步骤

出于运维安全考虑,建议在执行一键安装前,先下载脚本审查代码内容:

# macOS/Linux 环境

curl -fsSL https://gpukill.com/install | sh

# Windows (PowerShell) 环境

irm https://gpukill.com/install-windows | iex常用命令速查

gpukill watch:进入实时监控模式(类似 top 界面)。gpukill --list:快速列出所有显卡状态。gpukill --audit --rogue:扫描并识别异常占用模式。

注意事项

- 防止误杀:

--kill --gpu X命令会清除指定显卡上的 所有 进程。在多用户协作环境下,请务必配合--pid参数进行精准删除。 - 驱动依赖: 该工具依赖底层驱动支持。请确保已安装 NVIDIA Driver 或 ROCm;Mac M 系列用户可直接使用。

相关资源

- GitHub 项目主页: GPU Kill – Cross-platform GPU Management

- 官方文档: https://gpukill.com/(含 MCP 服务详细配置)

⚠️ 风险提示: 本工具涉及系统级进程管理。在生产环境操作时请保持谨慎,建议在执行终止命令前二次核对 PID,以免导致关键业务中断。