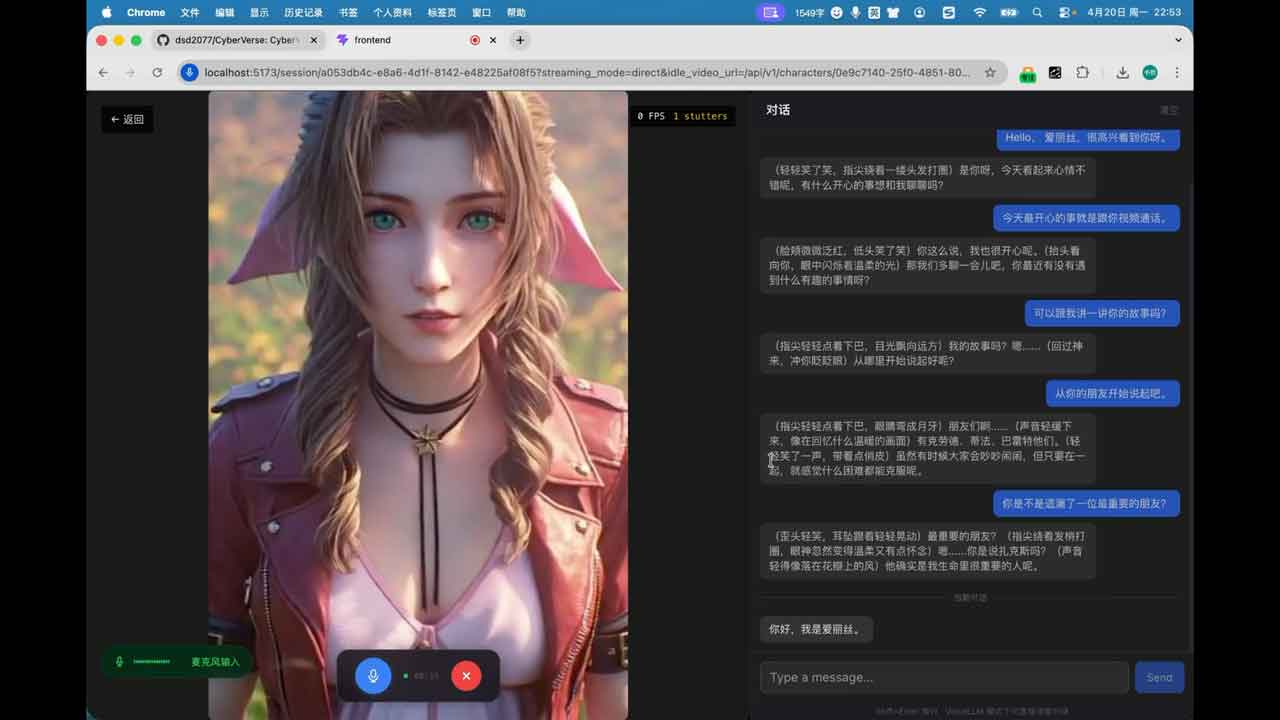

如果你想打造一个 AI 助手,但觉得传统的文字对话框太枯燥,或者在尝试各种云端数字人 SaaS 平台时被高昂的按分钟计费成本劝退,那么 CyberVerse 可能会是你关注的方案。它不是一个简单的聊天机器人套壳,而是一个允许你与 AI 数字人进行“实时视频通话”的开源框架。

简单来说,CyberVerse 将大语言模型(LLM)、语音识别(ASR)、语音合成(TTS)、头像驱动模型以及 WebRTC 视频流技术深度整合。它将原本碎片化的 AI 能力缝合在一起,实现了从“文字交互”到“带画面、有声音、口型同步”的实时多模态交互升级。

技术原理解析:从照片到实时视频流

与大多数停留在文本传输阶段的 AI 助手不同,CyberVerse 的核心竞争力在于其 组件化设计 与实时流媒体通讯能力。其完整的工作链路如下:

- 形象构建: 用户上传单张照片,生成数字人视觉形象。

- 语音交互: 采集用户麦克风输入 $rightarrow$ 语音识别 $rightarrow$ LLM 处理并生成文本回复。

- 多模态驱动: 文本转换为语音 $rightarrow$ 驱动面部动画与口型同步。

- 实时传输: 通过 WebRTC 技术 将最终的音视频流实时推送到网页端。

为了保证灵活性,该框架采用了插件化架构。开发者可以通过修改 YAML 配置文件,自由替换内部的 LLM 或 TTS 服务,以适配不同的业务需求或接口许可。

⚠ 开发进度提醒:

以下功能目前处于 Roadmap 规划阶段,尚未正式实现:长期记忆跨会话、工具调用与工作流执行、多 Agent 协作网络、知识库 RAG 问答、直播输出以及用户侧摄像头理解。

部署门槛:算力才是真正的“入场券”

虽然 CyberVerse 支持自托管,但它并非一款面向普通用户的轻量工具。对于开发者而言,真正的挑战不在于代码,而在于极高的环境配置要求与 GPU 算力成本。

环境依赖: 部署该项目需要同时配置 Python 3.10+、Node 18+ 和 Go 1.22+,且对底层驱动有严格要求(CUDA 12.8+ 与 PyTorch 2.8)。在启动时,你需要分别在三个终端拉起 Python 推理服务、Go API 服务和前端界面。

硬件瓶颈: 显卡性能直接决定了交互体验。根据官方测试数据,单张 RTX 4090 的表现如下:

- 使用 FlashHead Lite(轻量级面部模型):可实现 25+ FPS,达到实时流畅交互。

- 使用 FlashHead Pro(高画质模型):帧率掉至约 10.8 FPS,无法流畅互动。

- 若需运行 LiveAct 18B 等大参数模型,则需要 RTX PRO 6000 级别的专业显卡。

适用场景与人群分析

基于上述技术特性,CyberVerse 的适用人群画像非常明确:

✅ 推荐尝试:

- 需要快速构建数字人客服、虚拟前台或 AI 视频助手原型的工程团队。

- 拥有充足算力资源,且希望深入研究 WebRTC 与 LLM 集成的独立开发者。

❌ 不建议尝试:

- 寻找“一键安装包”或低门槛体验的普通用户。

- 缺乏高端 NVIDIA 显卡支持的设备环境。

- 计划直接将其作为成熟商业系统上线的团队(项目尚无正式 Release 版本,部署过程中需自行排坑)。

合规性注意事项

在利用该技术进行虚拟陪伴或人物复现时,请务必警惕肖像权、声音权及伦理红线。此类多模态生成技术在实际应用中具有较高的合规风险,建议在合法且获得授权的前提下使用。

项目资源入口

免责声明:本文仅对开源项目的架构与部署门槛进行客观技术评析。私有化部署涉及较高硬件成本,部分功能仍在规划中,实际表现请以官方最新版本为准。本站不提供亦不储存任何侵权模型资源,商业化使用前请自行核对 GPL-3.0 及相关第三方模型许可协议。