Edit Mind: Utilizzo dell'intelligenza artificiale per creare "indici semantici" per enormi quantità di filmati video.

EditMind è un'applicazione desktop multipiattaforma progettata per trasformare le librerie video in una base di conoscenza altamente ricercabile grazie alla tecnologia AI. Come un "secondo cervello per i montatori", analizza i video localmente, convertendo le informazioni visive e sonore in metadati strutturati, consentendo agli utenti di individuare rapidamente inquadrature precise utilizzando il linguaggio naturale, proprio come nella ricerca di un documento.

Analisi delle funzioni principali

1. Pipeline di indicizzazione profonda multidimensionale

EditMind ha creato localmente una catena completa di analisi basata sull'intelligenza artificiale, scomponendo i filmati video in dati strutturati e ricercabili:

- Trascrizione audio: Utilizza il modello OpenAI Whisper locale per generare testi di dialogo con timestamp precisi.

- Segmentazione fine: Il video è suddiviso in "segmenti" di circa 2 secondi ciascuno per garantire la precisione a livello di fotogramma nel recupero e nella localizzazione.

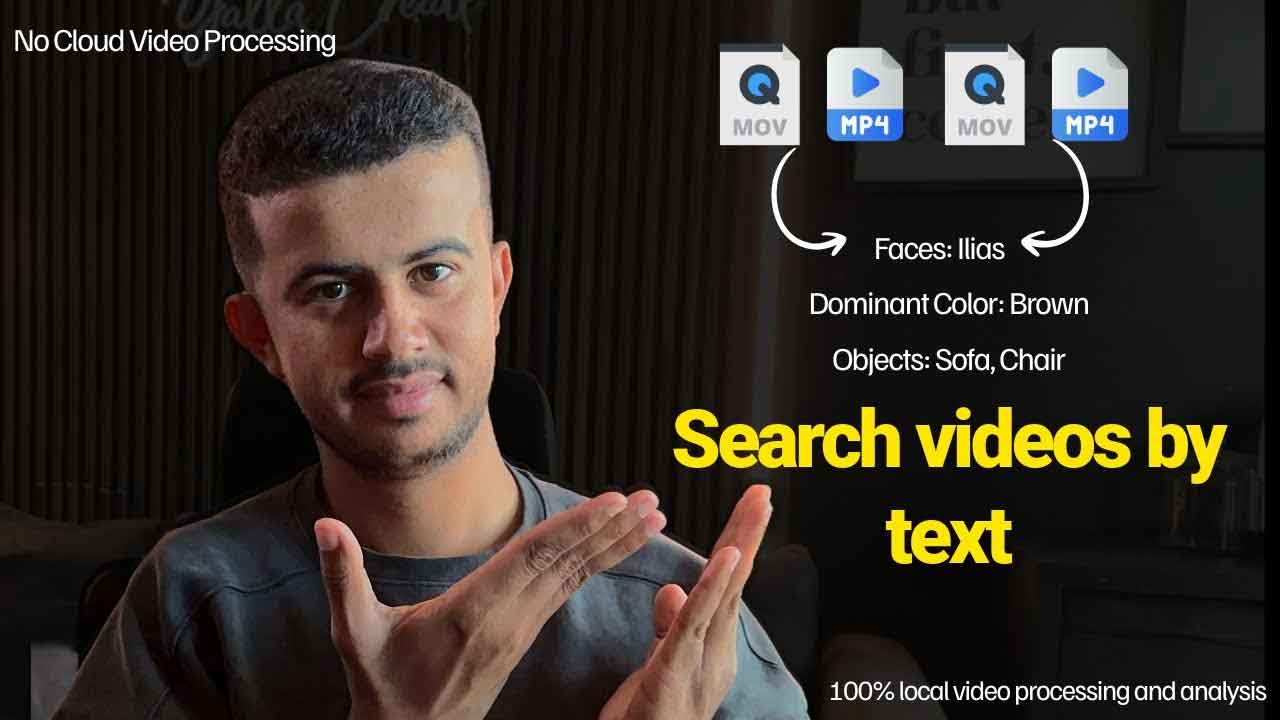

- Analisi visiva: Questo strumento utilizza un plugin Python per estrarre informazioni sui volti, rilevare oggetti, riconoscere il testo sullo schermo (OCR) e analizzare la combinazione di colori dominante e la composizione.

- Allineamento multimodale: Allineare il testo audio con i tag visivi lungo la timeline per ottenere una comprensione completa della scena.

Tutti i metadati estratti vengono vettorializzati utilizzando il modello di incorporamento del testo di Google e memorizzati localmente. ChromaDB Nei database vettoriali, il processo di indicizzazione è garantito essere efficiente e consente di effettuare query offline.

2. Ricerca semantica in linguaggio naturale

Gli utenti non hanno bisogno di ricordare nomi di file o timestamp; possono trovare i materiali semplicemente utilizzando descrizioni in linguaggio naturale. Ad esempio:"Trova tutte le foto in cui due persone sono sedute a un tavolo e parlano." O “Mostrami tutte le clip in cui Ilias sembra felice”。

il suo principio di funzionamento è quello di utilizzare Google Gemini 2.5 Pro Analizzare i comandi in linguaggio naturale degli utenti e convertirli in query JSON strutturate, abbinando poi gli scenari più pertinenti al database ChromaDB locale, migliora notevolmente l'efficienza della creazione guidata dall'ispirazione.

3. Taglio grosso automatizzato intelligente

Sfruttando le sue potenti funzionalità di ricerca, EditMind permette di generare sequenze di montaggio preliminare direttamente dalle descrizioni. Gli utenti devono semplicemente inserire le proprie richieste (ad esempio "Dammi tutte le inquadrature in cui @ilias sembra felice") e l'applicazione unisce automaticamente la timeline. Questo fa risparmiare tempo prezioso ai montatori, evitando loro di dover setacciare il materiale video, e le sequenze di montaggio preliminare generate possono essere importate in software professionali per ulteriori modifiche.

4. Progettazione architettonica che privilegia la privacy

Per proteggere i segreti commerciali e la sicurezza dei contenuti, EditMind ha adottato... "Elaborazione locale + accesso minimale al cloud" Strategia:

- Archiviazione locale: Il video originale, i dati dei fotogrammi e i metadati di analisi sono tutti archiviati localmente e non vengono caricati sul cloud.

- Invocazione controllata: Gemini e l'API di Google vengono richiamati solo durante le fasi di analisi semantica e incorporamento del testo, trasmettendo esclusivamente istruzioni e testo relativo alle funzionalità, non filmati video.

- Evoluzione futura: L'obiettivo è introdurre un modello di integrazione e interrogazione completamente offline per supportare ambienti offline estremi.

Specifiche tecniche e riferimenti prestazionali

Panoramica dello stack tecnologico

- Struttura e interfaccia: Electron + React + TypeScript + Vite (utilizzando shadcn/ui e Tailwind CSS)

- Logica di base: Node.js (processo principale) + Python (servizio plugin AI)

- Motore di intelligenza artificiale: PyTorch, OpenCV, Whisper

- magazzinaggio: ChromaDB (database vettoriale)

Test delle prestazioni hardware

Di seguito viene riportata l'analisi delle prestazioni per l'attivazione di tutti i plugin su un MacBook Max M1 (64 GB di RAM):

- Velocità di elaborazione: L'analisi di un'ora di video richiede circa 2-3 ore.

- Utilizzo della memoria: I valori di picco variano da 5 a 11 GB (influenzati dal formato di codifica e dalla complessità).

Scenari applicabili e raccomandazioni

Pubblico di riferimento

- Creatori professionisti: Blogger e video editor di breve formato che devono gestire enormi quantità di materiale.

- Team dei contenuti: Responsabile della gestione di un ampio archivio di materiali per video promozionali aziendali e registrazioni di corsi.

- Ricercatore tecnologico: Per gli sviluppatori interessati all'intelligenza artificiale multimodale, ai database vettoriali e al recupero semantico.

Precauzioni per l'uso

- Ottimizzare i tempi di analisi: Si consiglia di disabilitare i plugin non necessari ed eseguire l'elaborazione in batch durante le ore non di punta.

- Configurazione hardware: Si consiglia di avere almeno 16 GB di RAM e di utilizzare un'unità SSD per archiviare materiali e indici, al fine di garantire velocità di lettura e scrittura elevate.

- Stato della versione: Il progetto è attualmente in corso fase di sviluppo attivoNon ha ancora raggiunto la stabilità necessaria per la produzione e potrebbe contenere bug.

Esperienza e co-creazione: Gli sviluppatori possono contribuire ai progetti open source tramite GitHub:

https://github.com/IliasHad/edit-mind