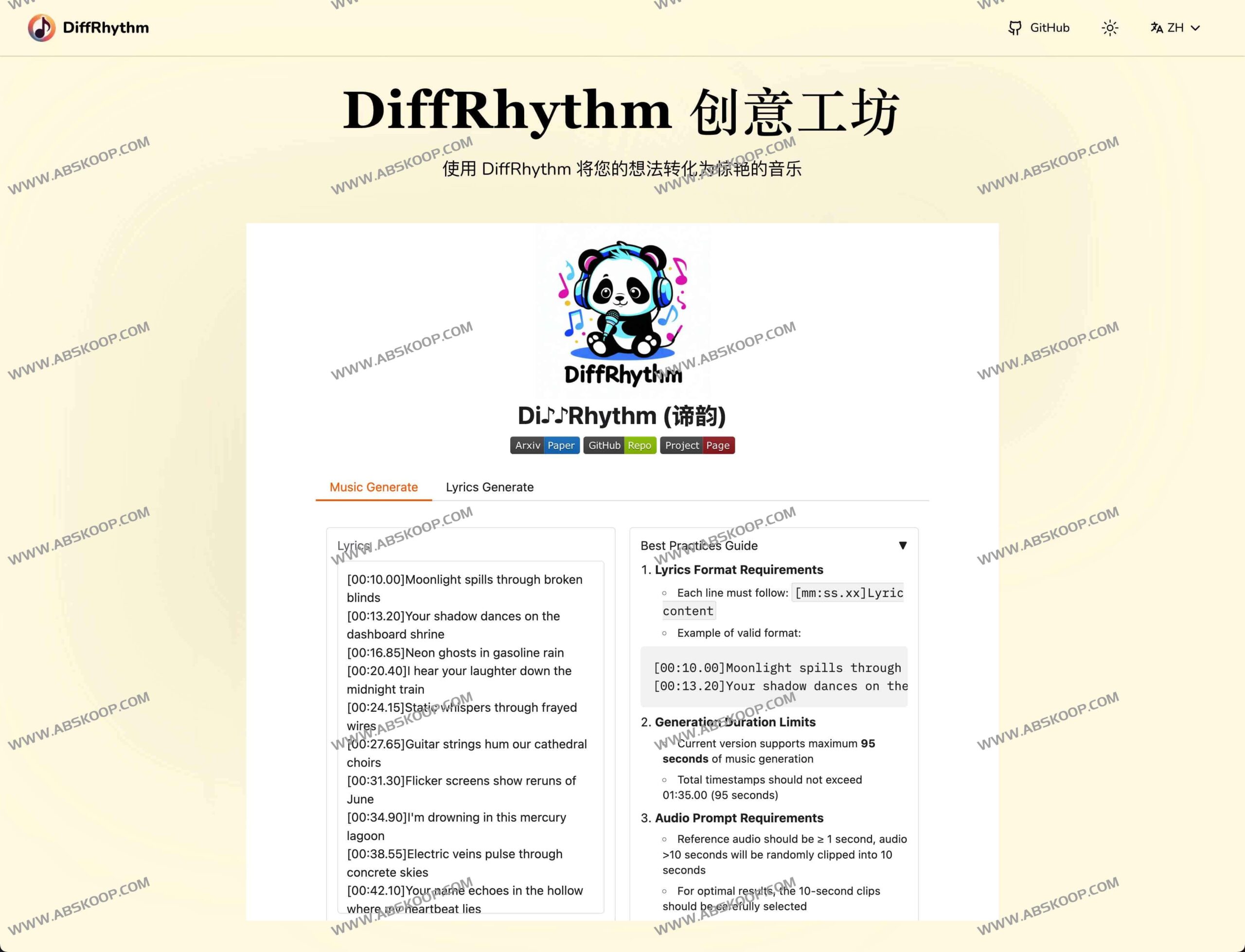

认识 DiffRhythm

DiffRhythm 是一款基于扩散模型(Diffusion Model)的 AI 音乐生成平台。它将复杂的编曲流程简化为简单的指令输入,让非专业用户也能快速创作出包含人声与伴奏的完整歌曲。

该平台采用非自回归架构,无需繁琐的数据预处理,即可实现歌词与旋律的精准同步。其核心优势在于极高的生成效率:仅需输入歌词和风格标签(如流行、电子、古典等),10 秒内即可产出作品,单曲最长支持 4 分 45 秒,且全面兼容中英文双语。

适用场景

- 自媒体创作:批量生成无版权争议的视频背景音乐。

- 音乐灵感捕捉:音乐人快速将创意草稿转化为可听的 Demo。

- 教育与演示:制作定制化的教学素材或演示音频。

- 个人表达:将文字歌词快速转化为完整单曲。

注意事项

在日常学习、分享和个人创作时,DiffRhythm 几乎没有使用门槛。但若涉及 商业用途,用户需确认作品的原创性,并建议明确标注 AI 参与创作。

快速上手

官方网站:https://diffrhythm.com/zh

GitHub 开源项目:https://github.com/ASLP-lab/DiffRhythm

正文完