Google AI Edge Gallery:将生成式 AI 彻底离线化

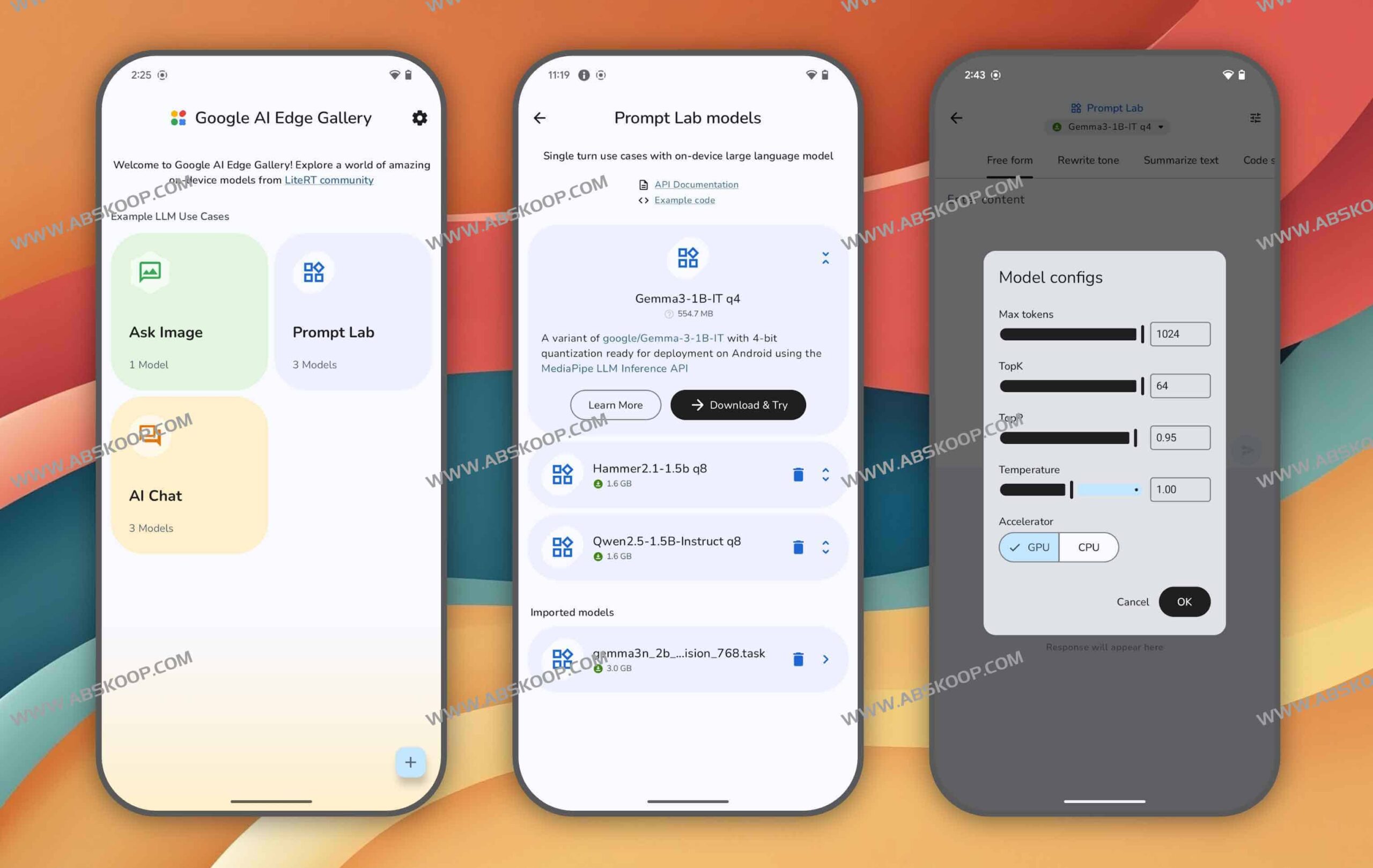

Google AI Edge Gallery 是一款由 Google AI Edge 团队开源的端侧 AI 演示应用,旨在让用户在手机上实现 “下载即用、完全离线” 的生成式 AI 体验。通过将所有推理计算迁移至本地,该工具在保障隐私的同时消除了网络延迟。目前该项目已在 GitHub 获得上万颗 Star,现已支持 Android 平台,iOS 版本正在开发中。

核心功能解析

Gallery 不仅是一个简单的聊天界面,而是一个集模型测试与多模态交互于一体的实验场:

- 全离线推理: 模型加载后即可切断网络,确保数据不上传云端,极速响应且隐私安全。

- 多模态交互能力:

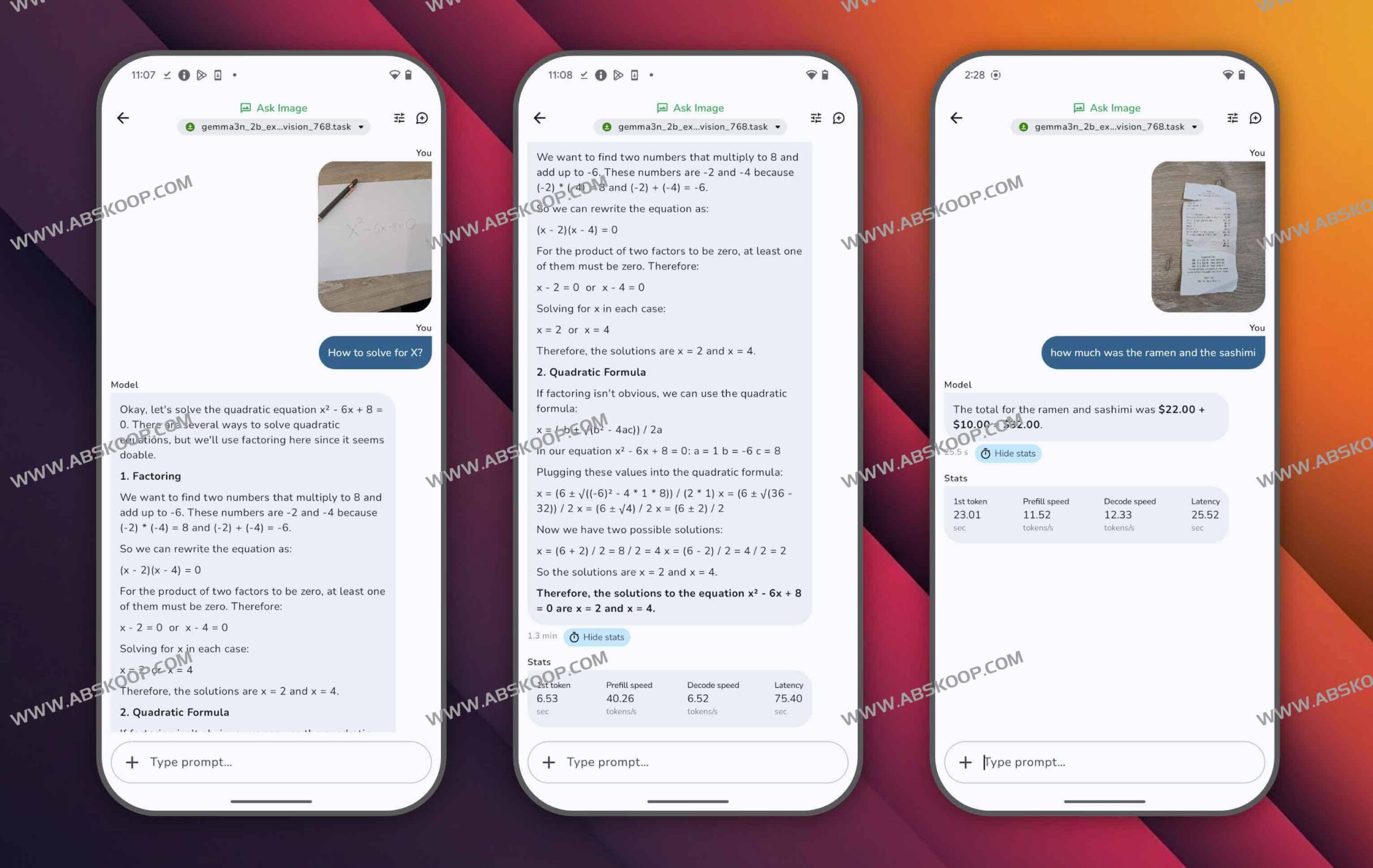

- Ask Image: 支持上传图片并进行识别、描述或复杂问题求解。

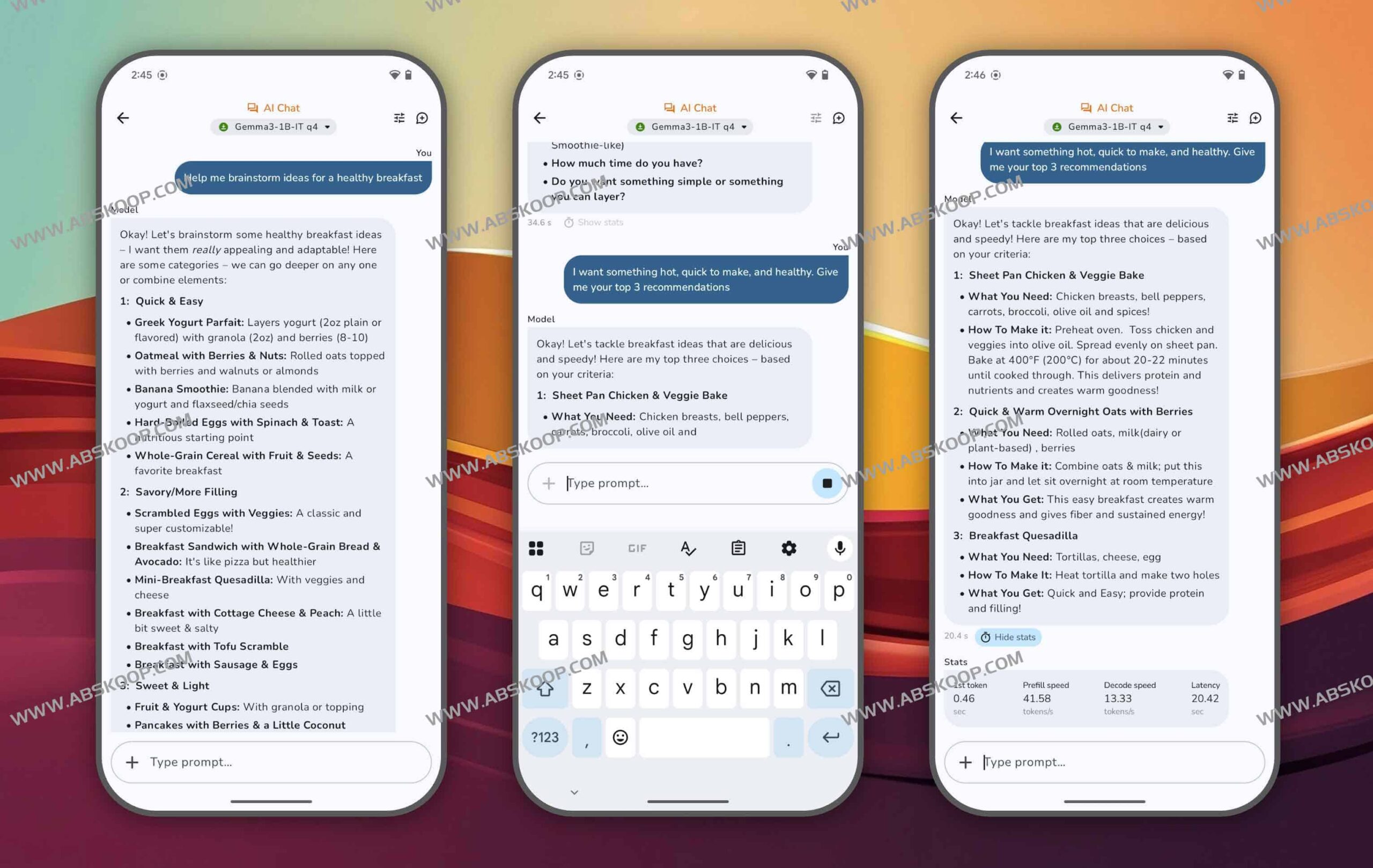

- AI Chat: 提供流畅的多轮对话,适用于日常问答与灵感激发。

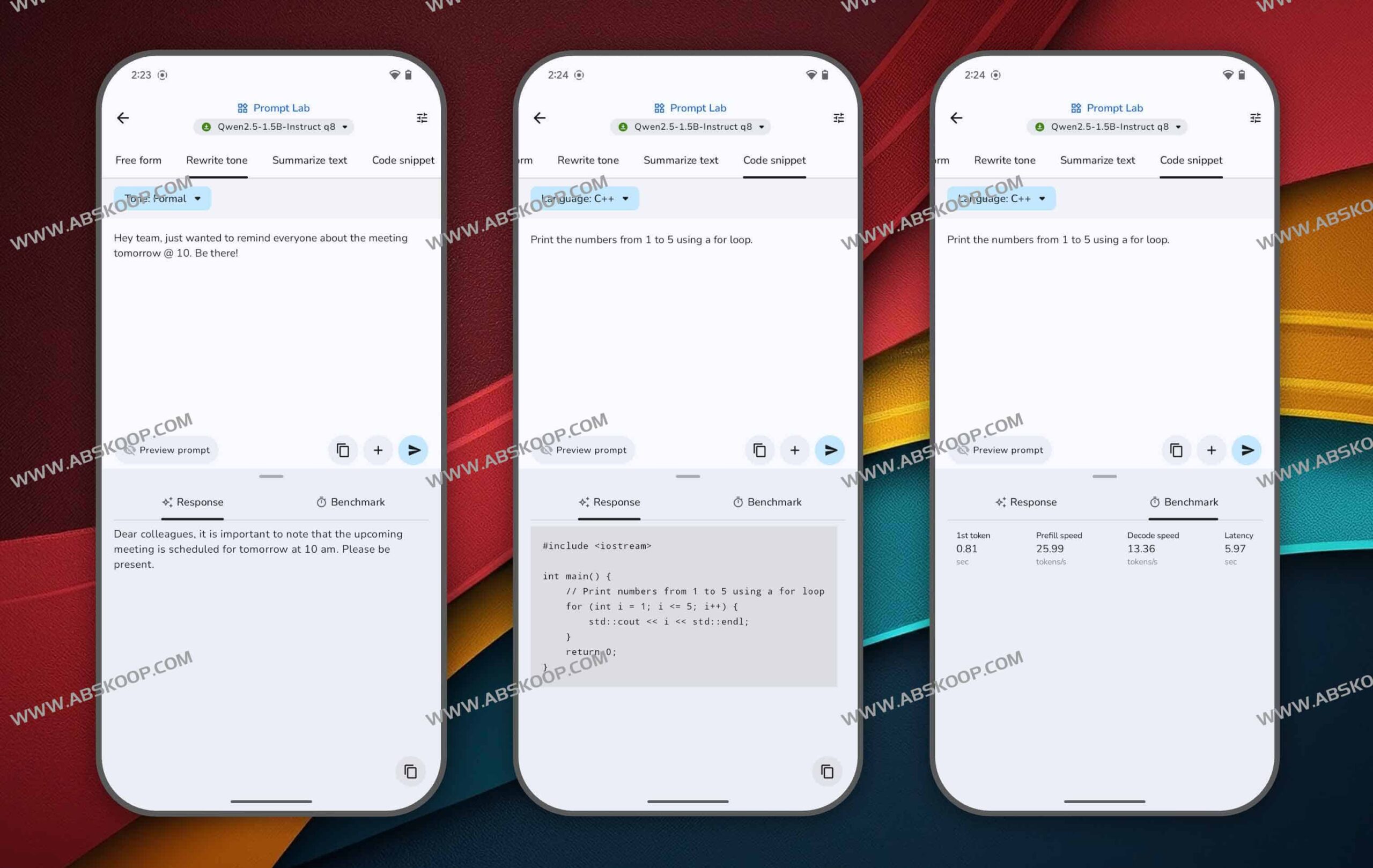

- Prompt Lab: 预设了代码生成、文本摘要、改写等单轮指令模板,方便快速验证 Prompt 效果。

- 模型动态切换: 内置 Hugging Face 浏览器,用户可一键导入或下载自定义的 LiteRT

.task模型,直观对比不同 LLM 的表现。 - 实时性能监测: 开发者可直接查看 TTFT(首字延迟)、解码速度及整体时延,量化评估端侧部署成本。

底层技术架构

Gallery 的高效运行依赖于 Google AI Edge 生态的深度集成:

- LiteRT 运行时: 作为 TensorFlow Lite 的演进版本,LiteRT 针对移动端硬件加速进行了深度优化,计划成为官方唯一的端侧运行时。

- LLM Inference API: 该 API 为 Android/iOS 提供了底层的离线执行能力,支撑起聊天与 Prompt Lab 的核心逻辑。

- 低代码 API 平台: 基于 Google AI Edge 的低代码框架,快速覆盖文本、视觉、音频等通用 AI 任务。

- Hugging Face 集成: 通过深度对接,用户可以无缝运行 Gemma、Qwen、Dia-1.6B 等量化后的主流模型。

适用场景

- 极高隐私需求: 在处理敏感数据或无网络环境时,完成文档总结或代码生成。

- 模型选型评测: 开发者通过性能面板对比不同量化模型的吞吐量与延迟。

- 稳定演示环境: 在会议或教学场景中避开不稳定的 Wi-Fi,确保 AI 演示流畅。

获取与安装

用户可通过 GitHub Release 页面或 Uptodown 下载 APK 安装包,将手机转化为个人的离线 AI 工作站。

下载链接: 网盘下载

正文完