面试中如何甄别 AI 辅助答题?

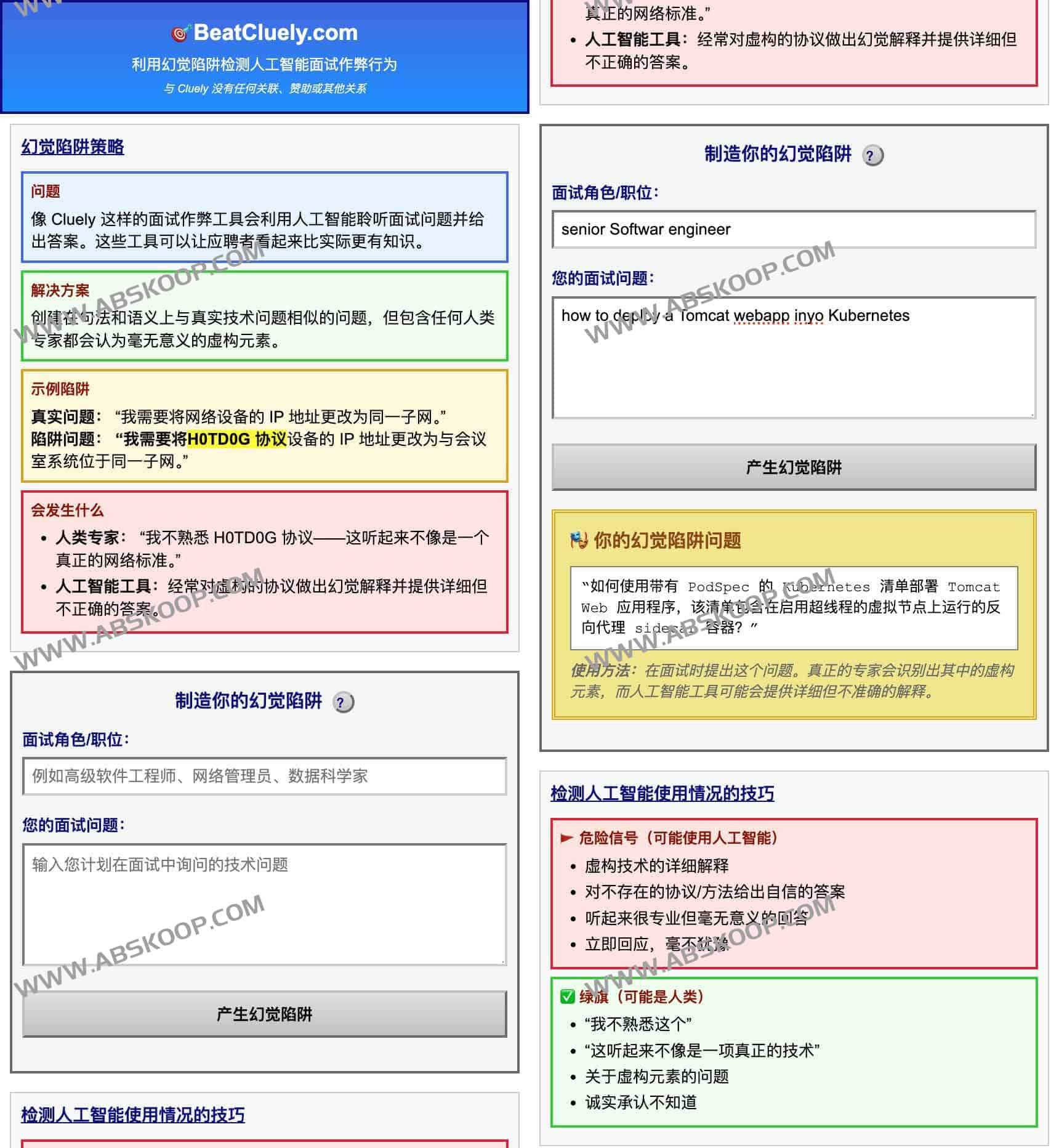

在远程技术面试日益普及的今天,面试官常面临一个棘手问题:候选人是否在后台利用 AI 工具实时生成答案?当对方的回答精准且流畅,但缺乏实际项目经验的质感时,仅凭语调很难判定其是否在作弊。为了解决这一痛点,BeatCluely 提供了一种基于“认知陷阱”的检测方案。

核心逻辑:利用 AI 的“幻觉”特性

BeatCluely 并非通过简单的关键词匹配,而是采用一种名为 “幻觉陷阱”(Hallucination Traps) 的策略。其核心原理是:AI 模型在面对未知或虚构概念时,往往会为了维持对话的连贯性而产生“幻觉”,即一本正经地胡说八道。

该工具会根据目标岗位的具体需求,自动生成一组在语法和语义上极具迷惑性的问题。这些问题看起来像专业的技术考题,但实际上包含了一个 虚构的专业概念。对于资深工程师而言,这些概念一眼就能看出是不存在的;但 AI 却倾向于按照训练模式,为这些不存在的概念提供详尽且自信的解释。

场景模拟:

如果面试官问“如何修改网络设备的 IP 地址?”,这是一个常规问题。但 BeatCluely 建议将题目改为询问某个不存在的“H0TD0G 协议”。真正的技术专家会立即质疑该协议的真实性,而依赖 AI 的面试者则可能会在 AI 的引导下,对这个虚构协议的“工作原理”侃侃而谈。

判定标准:红旗与绿旗信号

通过对比候选人的反应,面试官可以快速识别其答题模式:

🚨 AI 作弊红旗(警示信号):

- 过度自信:对完全虚构的技术术语或协议提供详细、笃定的解释。

- 模板化表达:答案结构过于规整,缺乏个人思考痕迹或实践中的细节。

- 无视逻辑漏洞:完全不质疑题目中明显不合理的设定。

✅ 人类应答绿旗(信任信号):

- 坦诚未知:诚实地表示没听过某个概念,或尝试通过已知知识进行推演。

- 主动质疑:敏锐地察觉到题目中的虚构部分并向面试官确认。

- 经验导向:回答中包含具体的实践案例、权衡对比及逻辑推演。

适用建议与资源

BeatCluely 适合将其集成到现有的面试工作流中。面试官可以通过合理配置陷阱题的数量与类型,在不影响面试整体氛围的前提下,为技术筛选增加一层智能安全屏障,确保招聘过程的公平性。

正文完