如何构建企业级私有 AI 知识库?

在企业数字化转型中,很多组织面临共同的痛点:一方面拥有海量的 PDF、Excel、Word 等文档资料,但检索效率低下;另一方面,出于数据安全考虑,无法将核心机密上传至公有云 AI 平台。如何在确保数据不出域的前提下,构建一个能够精准回答业务问题的智能问答系统?

由芝麻小客服推出的 ChatWiki 为此提供了解决方案。这是一个 开源且支持私有化部署的 AI 问答系统,它通过融合大语言模型(LLM)、检索增强生成(RAG)以及 GraphRAG 知识图谱技术,将复杂的文档处理与模型调用流程简化为“开箱即用”的工具链,助力企业快速搭建端到端的智能客服与知识管理体系。

核心功能亮点

- 多模态文档解析: 深度支持 PDF、DOCX、OFD 等多种格式。系统不仅能提取文本,还能自动识别并提取内嵌图片,确保 AI 回复时能够提供图文并茂的精准参考。

- 进阶检索架构: 结合向量检索与 GraphRAG 知识图谱,有效解决了传统 RAG 容易丢失上下文的问题,显著提升了复杂查询的命中率与答案的相关性。

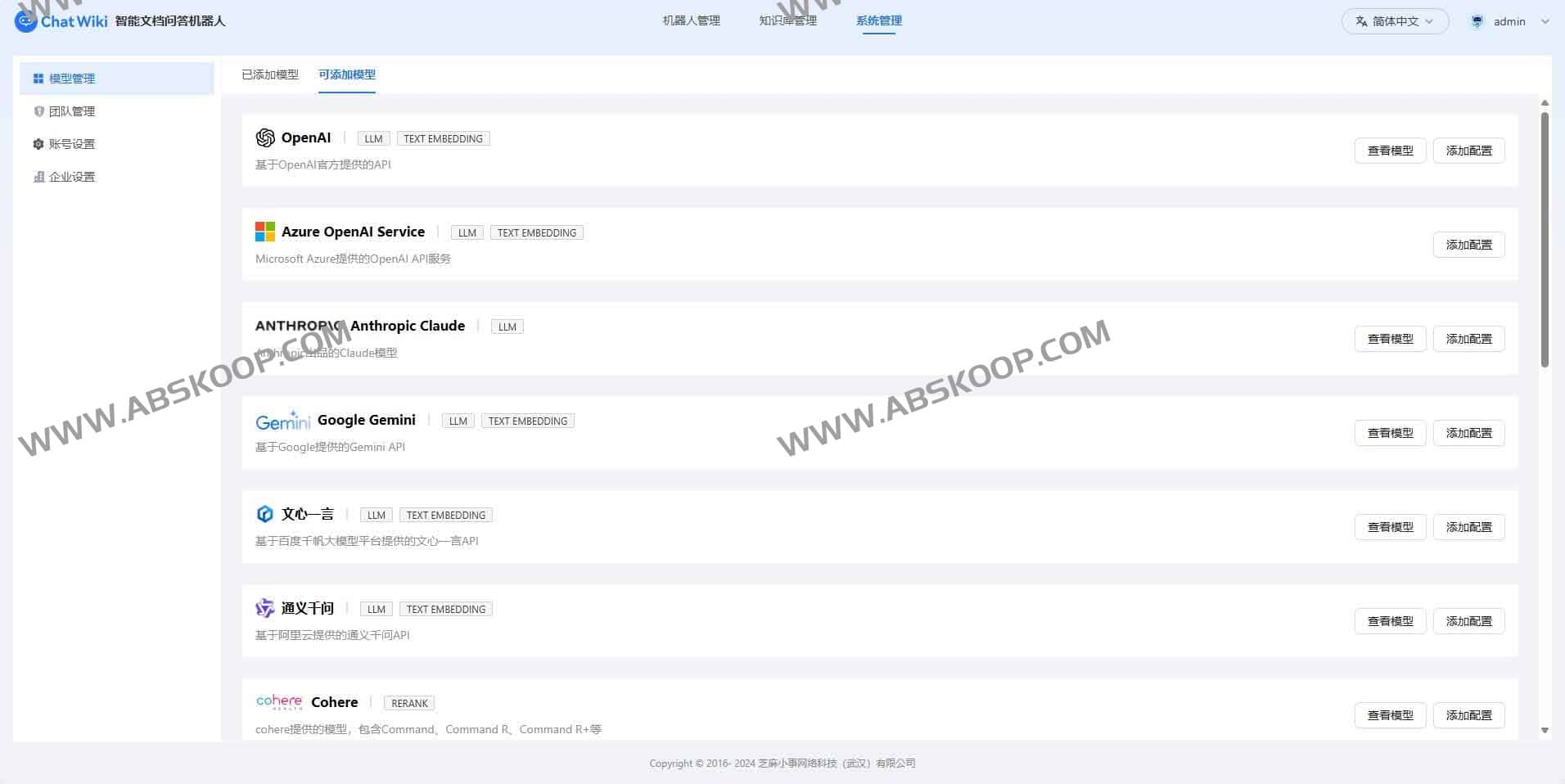

- 灵活的模型调度: 兼容 DeepSeek、通义千问、豆包、OpenAI、Claude 等 20 余种主流模型。用户可通过可视化界面快速接入 API,无需编写代码即可完成工作流编排。

- 智能交互体验:

- 上下文优化: 实时分析会话,自动补全模糊提问,并提供“猜你想问”的语义推荐。

- 多语言支持: 内置中英文对照阅读模式,支持实时翻译。

- 感官增强: 集成语音识别与 TTS 语音合成,并支持定制化角色(如趣味性的“暴躁教授”),让 AI 交互更具人性化。

- 全渠道触达: 提供开放 API 供二次开发,并原生支持 H5 链接、桌面端、微信小程序 / 公众号、抖音企业号等多种终端接入。

界面预览

部署与安全保障

针对企业级场景,ChatWiki 将 安全性 放在首位。所有数据均存储在本地数据库中,通过多层加密传输、严格的访问权限控制(管理员 / 编辑员 / 只读成员)以及完整的审计日志,确保符合 GDPR 和等保 2.0 等合规要求。

在部署便捷性方面,项目代码完全开源且支持商用,开发者可以通过 Docker 或 Kubernetes 环境实现快速部署,无需支付额外的许可费用。

资源链接

- 项目地址: GitHub – zhimaAi/chatwiki

- 在线体验: https://chatwiki.com

- 客户端下载: 点击跳转网盘

正文完