🤯 摆脱高端服务器:在低配硬件上运行 AI Agent

想要在 Dispositifs embarqués 或旧硬件 上部署 AI 助手,最大的痛点往往是资源开销。主流 AI 框架依赖沉重的 Python 或 Node.js 环境,动辄占用数 GB 内存,这让几十元一个的 Linux 开发板难以承受。

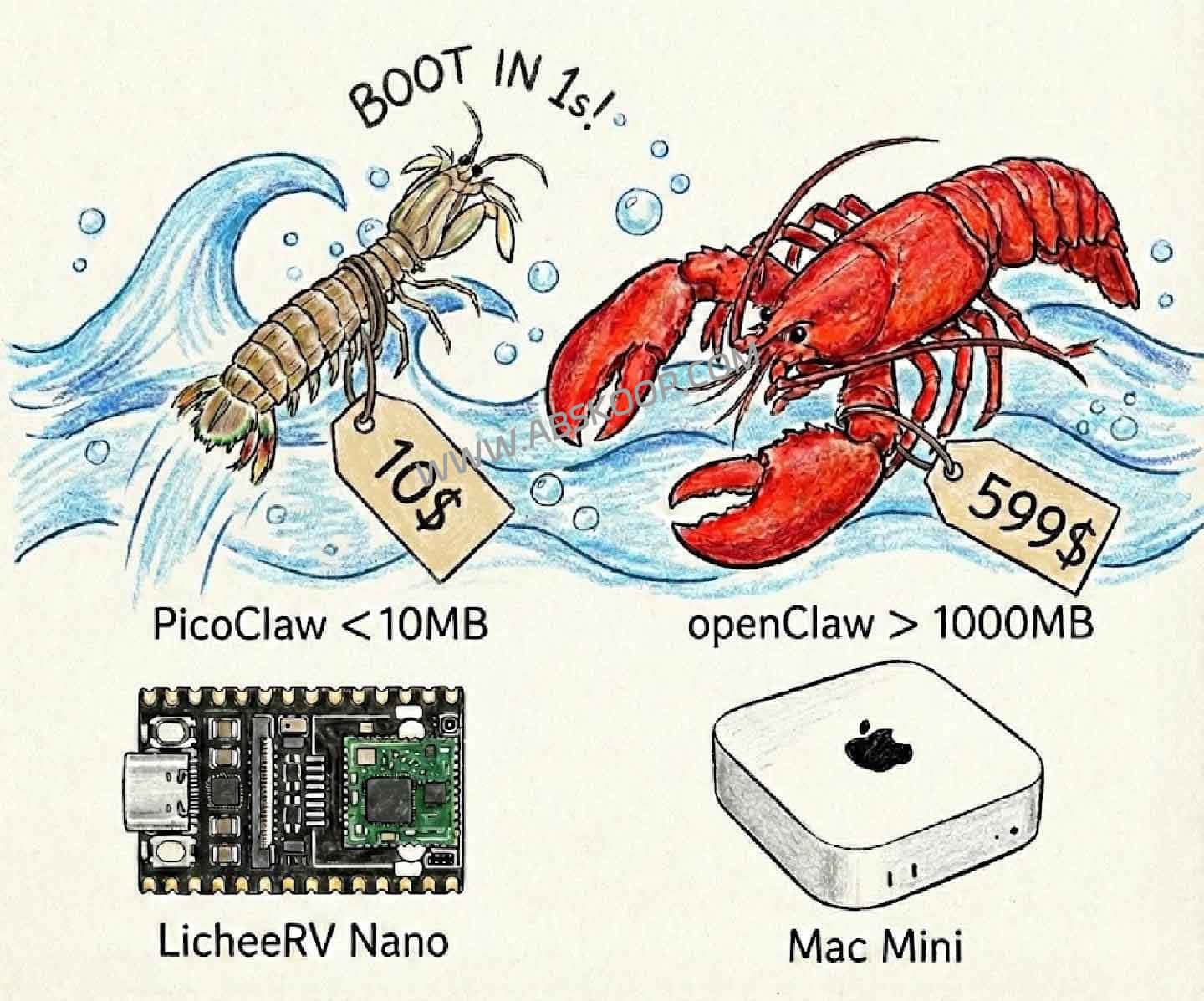

针对这种「工程落地」难题,PicoClaw 提供了一个极致轻量化的方案。它通过 Go 语言 重构,将运行时依赖和内存占用压至最低,让 10 美元级别的低配硬件也能常驻运行 AI 助手。

PicoClaw:面向边缘计算的轻量化设计

PicoClaw (GitHub: sipeed/picoclaw) 是一款专为 边缘计算场景 打造的开源 AI 助手。其核心逻辑在于「极简主义」:利用 Go 语言编译为单一二进制文件 (Single Binary),彻底剔除了繁琐的环境配置。

这意味着它可以无缝运行在 LicheeRV Nano、NanoKVM 甚至家用路由器等极低功耗设备上,具备以下特性:

- 秒级启动: 在 0.6GHz 单核 CPU 的环境下,启动时间仅需约 1 秒。

- 极致内存: 核心常驻内存通常 < 10MB,极大减轻了硬件压力。

- 零依赖部署: 无需安装 Python 虚拟环境或 Node 模块,下载即用,运维成本极低。

核心功能:从简单响应到自动化调度

PicoClaw 不仅仅是「轻」,它在功能设计上更倾向于成为一个自动化的任务中枢。

1. 异步任务与智能调度

系统内置了 Cron 定时任务与 Heartbeat 心跳机制。用户可以通过 Markdown 规则定义自动化行为,例如「每半小时监测天气」或「追踪特定 API 变动」。对于联网搜索或复杂推理等耗时任务,它采用 spawn 机制启动独立进程异步处理,确保主线程不会因为等待响应而阻塞,非常适合作为常驻的通知提醒器。

2. 多平台消息网关 (Gateway Mode)

通过 Gateway 网关模式,PicoClaw 可以快速接入 Telegram、Discord、钉钉等第三方平台。配合 Token 配置,你可以将一台低功耗设备转化为 24 小时在线的事件通知节点,处理标准化的问答流程或信息转发。

3. 解耦的 LLM 后端支持

PicoClaw 将模型层与逻辑层分离,支持灵活配置后端。无论是调用 DeepSeek、智谱 (Zhipu) 等国内 API,还是通过 OpenRouter 接入海外模型,均可通过配置文件快速切换。此外,结合 Brave Search API 的免费额度,它还能实现基础的联网搜索与信息总结。

方案对比:为什么选择 PicoClaw?

| 方案 | 技术栈 | 内存占用 (官方参考) | 启动速度 | Scénarios applicables |

|---|---|---|---|---|

| PicoClaw | Go | < 10MB | 极快 (< 1s) | 嵌入式 / 极低配设备 |

| OpenClaw | Node.js | > 1GB | 较慢 (> 30s) | 桌面级 / 服务器 |

| Python Agent | Python | > 500MB | 中等 (> 10s) | 开发 / 科研环境 |

注意事项

- 🛡️ 安全警示: 项目方明确表示无任何「募资」或「代币」计划。请警惕任何以该项目名义进行的资金宣传。

- 🌐 访问控制: 建议不要将网关服务直接暴露在公网。推荐使用 VPN 或通过白名单限制可信 IP 访问,以确保数据安全。

- 📈 性能波动: 内存 < 10MB 及 1 秒启动基于官方特定环境。实际占用会随设备架构、运行负载及加载插件的数量而有所波动。

📥 资源获取

⚠️ 技术免责声明: 本文旨在分享开源技术方案。由于项目迭代迅速,具体配置参数与支持平台请以 GitHub 仓库最新文档为准。