Edit Mind:用 AI 为海量视频素材建立“语义索引”

Edit Mind 是一款跨平台桌面应用,旨在通过 AI 技术将视频库转化为可深度检索的知识库。它像一个“剪辑师的第二大脑”,通过在本地分析视频,将视觉与听觉信息转化为结构化元数据,让用户能够像搜索文档一样,通过自然语言快速定位精准镜头。

核心功能解析

1. 多维度深度索引流水线

Edit Mind 在本地构建了一套完整的 AI 分析链条,将视频画面拆解为可检索的结构化数据:

- 音频转写: 调用本地 OpenAI Whisper 模型,生成带有精确时间戳的对白文本。

- 精细切分: 将视频以约 2 秒为单位切分为“片段”,确保检索定位达到帧级精度。

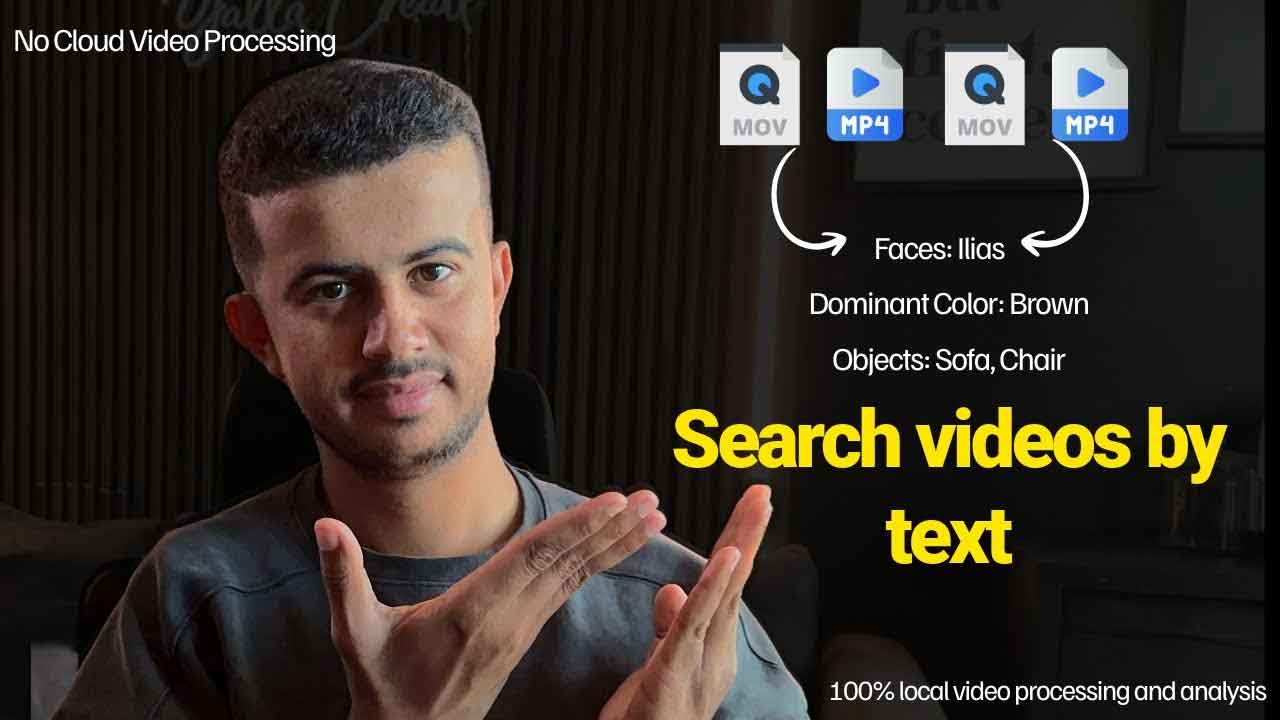

- 视觉分析: 通过 Python 插件提取人脸信息、检测物体、识别屏幕文字(OCR)并分析主色调与构图。

- 多模态对齐: 将音频文本与视觉标签按时间轴对齐,实现对场景的综合理解。

所有提取的元数据均通过 Google 文本嵌入模型向量化,并存储在本地 ChromaDB 向量数据库中,确保索引过程高效且可离线查询。

2. 自然语言语义搜索

用户无需记忆文件名或时间码,直接使用自然语言描述即可找素材。例如:“找出所有两个人坐在桌边说话的镜头” or “show me all clips where Ilias looks happy”。

其工作原理是利用 Google Gemini 2.5 Pro 将用户的自然语言指令解析为结构化 JSON 查询,随后在本地 ChromaDB 中匹配最相关的场景,极大提升了灵感驱动的创作效率。

3. 智能粗剪自动化

基于强大的检索能力,Edit Mind 支持通过描述直接生成粗剪序列。用户只需输入需求(如“给我所有 @ilias 看起来很开心的镜头”),应用即可自动拼接时间线。这为剪辑师省去了繁琐的素材筛选时间,生成的粗剪序列可随后导入专业软件进行精修。

4. 隐私优先的架构设计

为了保障商业机密与内容安全,Edit Mind 采取了 “本地处理 + 极简云端调用” 的策略:

- 本地存储: 原始视频、帧数据及分析元数据全部保留在本地,不上传云端。

- 受控调用: 仅在语义解析和文本嵌入阶段调用 Gemini 与 Google API,传输的仅是指令和特征文本,而非视频素材。

- 未来演进: 计划引入完全离线的嵌入与查询模型,以支持极端断网环境。

技术规格与性能参考

技术栈概览

- 框架与界面: Electron + React + TypeScript + Vite (使用 shadcn/ui 与 Tailwind CSS)

- 核心逻辑: Node.js (主进程) + Python (AI 插件服务)

- AI 引擎: PyTorch, OpenCV, Whisper

- 存储: ChromaDB (向量数据库)

硬件性能实测

The performance analysis for enabling all plugins on an M1 MacBook Max (64GB RAM) is as follows:

- 处理速度: 分析 1 小时视频约需 2-3 小时。

- 内存占用: 峰值在 5-11 GB 之间(受编码格式及复杂度影响)。

适用场景与建议

Target audience

- 专业创作者: 需要管理海量素材的短视频博主、剪辑师。

- 内容团队: 负责企业宣传片、课程录制的大规模素材库管理。

- 技术研究者: 对多模态 AI、向量数据库及语义检索感兴趣的开发者。

使用注意事项

- 优化分析时间: 建议关闭不必要的插件,并利用非工作时间进行批量处理。

- 硬件配置: 推荐 16GB 以上内存,并使用 SSD 存储素材与索引以保证读写速度。

- 版本状态: 项目目前处于 积极开发阶段,尚未达到生产级稳定,可能存在 Bug。

体验与共建: 开发者可通过 GitHub 参与开源贡献:

https://github.com/IliasHad/edit-mind