📊 Praktischer Leitfaden: Datenvisualisierung mit Code analysieren

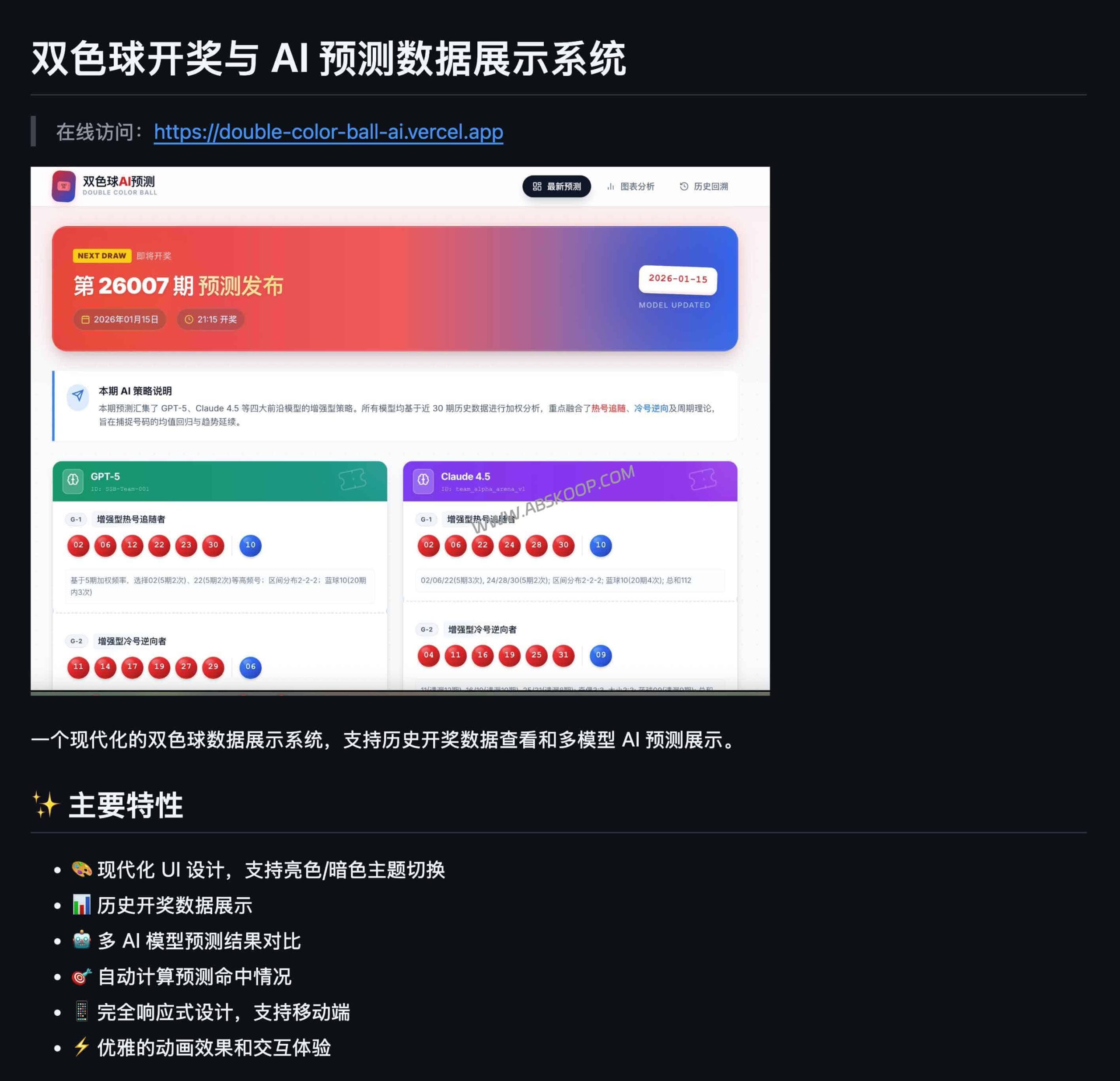

Für Entwickler ist die Beherrschung von Python-Webcrawler Und Vue.js/React-Visualisierung Am besten eignet sich die Durchführung praktischer Übungen mit realen, regelmäßig aktualisierten Datensätzen. (GitHub-Open-Source-Projekte) Doppelfarben-Kugel-KI Es bietet ein hervorragendes Referenzbeispiel für die Full-Stack-Entwicklung.

Dieses Projekt demonstriert vollständig den gesamten Prozess von der Bereinigung riesiger Mengen historischer Daten und der Durchführung von ECharts-Trendanalysen bis hin zum Vergleich der Unterschiede in der Art und Weise, wie verschiedene große Modelle (wie DeepSeek und GPT) strukturierte Daten verarbeiten.

Projektübersicht: Allgemeines Datenanzeige-Dashboard

Dies ist ein universelles Daten-Dashboard, das auf einem modernen Webtechnologie-Stack basiert. Sein Hauptnutzen liegt im Aufbau eines kompletten Systems."Datenverarbeitungslink":

- hinteres Ende: Automatisierte Datenerfassung und -bereinigung.

- Zwischenschicht: Der Algorithmus berechnet statistische Kernindikatoren wie Popularität und Streuung.

- Frontend: Die verarbeiteten Ergebnisse werden in einem interaktiven Diagramm dargestellt.

Man kann es als ein "Statistik + Front-End-Entwicklung" Dies ist eine praktische Vorlage, um zu lernen, wie man trockene Zahlen in intuitive Business-Intelligence-Visualisierungen (BI-Visualisierungen) umwandelt.

Kerntechnologie-Implementierung

1. Datenbereinigung und ECharts-Praxis

Das Projekt demonstriert den kompletten Workflow von den Rohdaten bis zu den visualisierten Diagrammen: Das Backend-Skript standardisiert die Webseitendaten im JSON-Format, und das Frontend ruft sie auf... ECharts oder Recharts Diese Bibliothek wandelt statistische Konzepte wie Intervallverteilung und Summentrends in dynamische Linien- und Balkendiagramme um. Entwicklern, die sich mit Frontend-Bibliotheken für Diagrammerstellung vertraut machen möchten, steht damit direkt wiederverwendbarer Referenzcode zur Verfügung.

2. LLM Strukturierte Ergebnisbewertung

Dies ist das technisch wertvollste Modul des Projekts. Durch die Konfiguration von APIs wie GPT-4o, Claude 3.5 und DeepSeek können Benutzer verschiedene Modelle analytische Texte für denselben Satz statistischer Indikatoren generieren lassen, was einen intuitiven Vergleich ermöglicht.

- JSON-Konformitätsfunktionen: Entspricht die Modellausgabe strikt der vordefinierten Struktur?

- Interpretierbarkeit der Argumentation: Ist der Analyseprozess logisch nachvollziehbar?

- Konsistenz der Schlussfolgerungen: Interpretieren unterschiedliche Modelle dieselben Daten auf konsistente Weise?

3. Implementierung des Feature-Engineering-Algorithmus

Das Projekt umfasst mehrere klassische Datenanalyselogiken, die zur Untersuchung von Feature Engineering verwendet werden können:

- Frequenzanalyse: Um die Datendichteberechnung innerhalb eines bestimmten Zeitfensters zu erreichen.

- Mittelwertrückkehr: Dies verdeutlicht die Logik hinter dem Erholungstrend von Artikeln mit niedriger Handelsfrequenz über einen längeren Zeitraum.

- Diskretisierungsberechnung: Der Algorithmus analysiert das Gleichgewicht zwischen geraden und ungeraden Zahlen sowie die Größenverteilung.

Einsatzvorschläge und Vorsichtsmaßnahmen

- 💻 Abhängigkeit von der Umwelt: Das Frontend benötigt Node.js, die Datenverarbeitung Python. Wir empfehlen die Verwendung von...

python -m http.serverAlternativ kann das Projekt ein eigenes Skript verwenden, um die Anwendung zu starten und so CORS-Cross-Domain-Fehler im Browser zu vermeiden. - 🔑 Tokenkosten: Die LLM-Vergleichsfunktion erfordert die Konfiguration eines API-Schlüssels. Bitte beachten Sie den Token-Verbrauch aufgrund des umfangreichen historischen Datenkontexts.

- 📚 Lernpositionierung: Dieses Projekt ist eine Lernressource für die Programmierung mit Schwerpunkt auf Datenvisualisierung und Algorithmenlogik. Bitte verfolgen Sie dabei eine rein technische Forschungsperspektive.

📎 Ressourcenbeschaffung

⚠️ Technische Beschreibung: Dieses Projekt dient ausschließlich als Lernfallstudie für Full-Stack-Entwicklung und Datenvisualisierung. Sämtliche Daten und Algorithmenausgaben werden nur zur Veranschaulichung der Programmlogik verwendet.Es besitzt keine Vorhersagefähigkeiten.Dies stellt keine Beratung dar.