如何量化大模型 API 的真实性能?

在选择 LLM 供应商或优化 AI 应用时,开发者经常面临两难:是追求 GPT-4 的强逻辑能力,还是选择 Gemini 的快速响应?单纯依赖官方宣传的 TPS(每秒 Token 数)往往无法反映实际的网络延迟与稳定性。为了解决这一痛点,LLM API Test 提供了一套标准化的量化方案,帮助用户在真实环境下对比不同模型的性能表现。

LLM API Test 核心能力分析

这款基于 MIT 协议开源的 Web 工具,旨在通过实时数据采集,将大模型 API 的性能指标可视化。它不仅支持 7 种语言,且由于采用静态托管部署,开发者可以极低成本快速搭建私有测试环境。

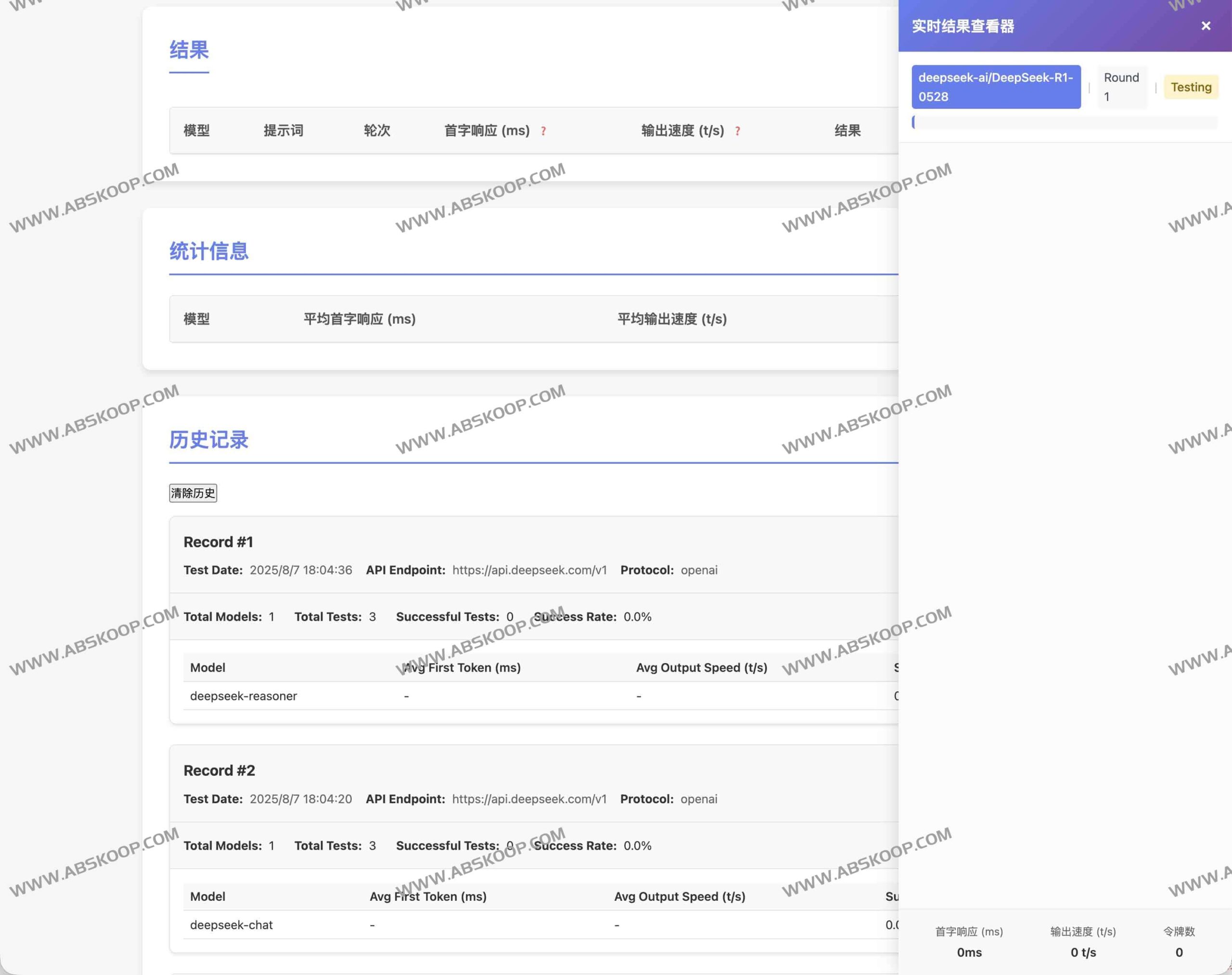

1. 关键性能指标

- 首令牌延迟 (TTFT):衡量模型响应的即时性,直接影响用户的感知速度。

- 输出吞吐量 :实时统计每秒生成的 Token 数量 (Tokens/s),评估生成效率。

- 调用成功率 :通过连续请求跟踪 API 的稳定性,识别潜在的限流或宕机风险。

- 质量比对 :支持将多个模型的响应内容并列显示,直观评估输出质量。

2. 广泛的兼容性与部署

- 协议支持 :原生适配 OpenAI (GPT-3.5/4 系列) 与 Google Gemini (Pro/Pro Vision),同时兼容所有 OpenAI 标准协议的自定义端点。

- 灵活部署 :支持通过 Node.js 本地运行,或一键部署至 Vercel、Netlify、GitHub Pages 等静态托管平台,亦提供 Dockerfile 方便容器化部署。

- 交互体验 :响应式界面适配多端设备,内置历史记录功能,方便用户跟踪模型版本的迭代性能。

为什么性能基准测试至关重要?

随着 GPT-4.1 nano 等低延迟模型的出现,毫秒级的响应差异已成为产品竞争力的核心。业界对标准化的趋势愈发明显:

- 网络路径影响 :lmspeed.net 等社区排行榜证明,同一模型在不同地域的 API 延迟差异巨大,开发者必须验证实际链路。

- 行业标准化 :NVIDIA 的 GenAI-Perf 与 MLCommons 的 MLPerf Client 1.0 均在推动 LLM 负载指标的标准化,使性能评估具备可比性。

适用场景

- 供应商选型 :在采购前对比 GPT-4 Turbo 与 Gemini Pro 的速度、成本与质量,选择性价比最高的方案。

- 应用性能调优 :参考 TechRadar 2025 指南,在吞吐量、生成质量与 API 成本之间寻找最优平衡点。

- 学术研究与验证 :可与 LangChain 等基准环境互补,针对工具调用和函数执行能力进行专项性能验证。

快速上手指南

- 环境搭建 :克隆项目仓库,执行

npm install && npm start,随后访问http://localhost:8000。 - 参数配置 :在配置面板中指定协议,填入 API URL 及密钥,并定义需要测试的模型名称。

- 执行测试 :设定测试轮次、并发数及自定义 Prompt,点击 Start Test 即可实时获取性能图表。

相关资源

演示地址:https://llmapitest.com/?lang=zh

GitHub 仓库:https://github.com/qjr87/llm-api-test

正文完