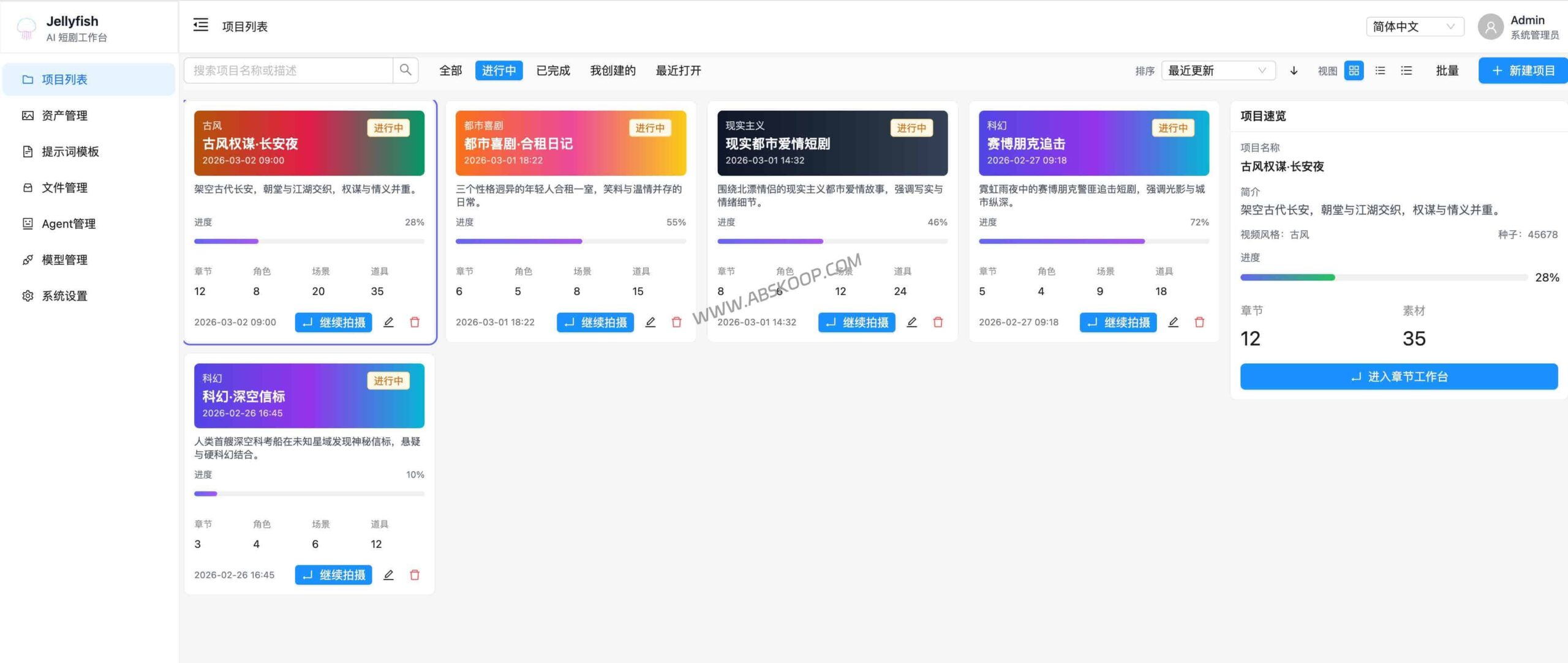

告别“人工缝合”:开源 AI 短剧工作流 Jellyfish 深度解析

在 AI 视频创作领域,生成单个片段并不难,真正的挑战在于如何维持故事的连贯性。目前的短剧创作模式大多依赖于“手动抽卡”:在文本模型中撰写剧本,在 Midjourney 中通过垫图尝试,最后将素材丢进视频模型等待结果。

创作痛点: 角色在不同镜头间频繁“变脸”(人物漂移),导致创作者不得不维护庞大的提示词表格,在各个工具间反复复制粘贴,将高效的 AI 创作变成了低效的“赛博打螺丝”。

Jellyfish 旨在打破这种割裂感。作为一个开源项目,它不开发底层模型,而是构建一套集成工作流,尝试将剧本创作、分镜设计、角色资产管理、视频生成与后期剪辑串联在同一套逻辑之下。

核心逻辑:如何解决人物漂移与流程割裂?

Jellyfish 的核心思路是将视频创作“积木化”,通过强化资产复用逻辑来降低随机性:

- 全局风格锚定: 在项目创建阶段锁定统一的风格与种子值,最大限度减少分镜间的视觉偏差。

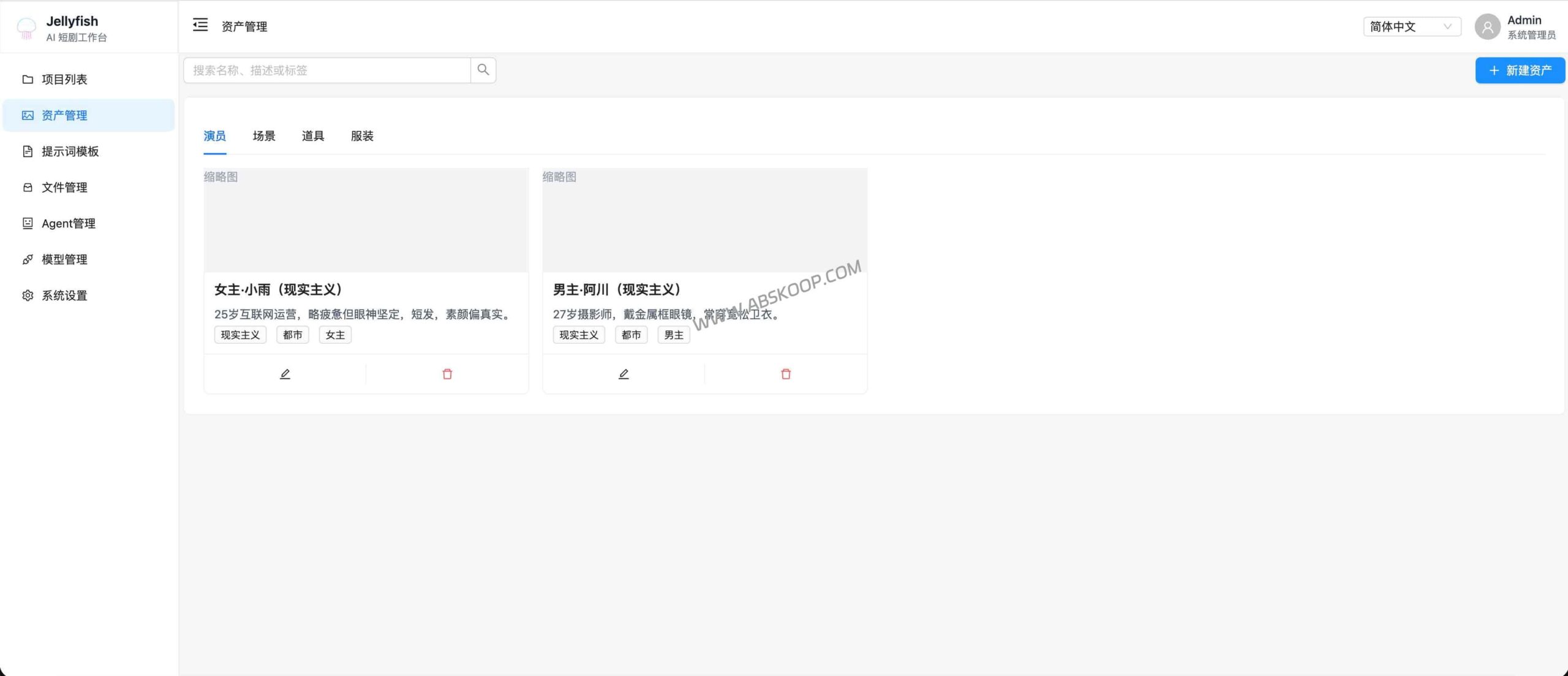

- 双层资产库管理: 将预设的角色形象、关键装备存入资产库并打标签。后续调用时直接检索标签,无需重复编写冗长的 Prompt。

- 精细化分镜控制: 提供更直观的分镜编辑能力,例如支持为首尾关键帧独立设置提示词,提升画面转场的精准度。

适用环境与模型接入:

Jellyfish 不提供算力支持,用户需自备 API Key。其设计支持文本端对接 OpenAI、Claude 等模型,视频端则兼容 Kling、Runway、Luma 等主流服务。

Jellyfish 不提供算力支持,用户需自备 API Key。其设计支持文本端对接 OpenAI、Claude 等模型,视频端则兼容 Kling、Runway、Luma 等主流服务。

技术部署与避坑指南

对于希望通过源码部署的开发者,Jellyfish 的界面框架和模型管理模块已可运行,但在前后端联调阶段需注意以下细节:

关键步骤:同步前端接口

由于前端请求基于后端的 OpenAPI 规范自动生成,若启动后出现接口报错,请先确认后端在

由于前端请求基于后端的 OpenAPI 规范自动生成,若启动后出现接口报错,请先确认后端在

8000 端口正常运行,随后在前端目录下执行 pnpm run openapi:update 以更新类型文件。注意事项: 根据官方 Roadmap,核心的分镜渲染链路仍处于开发中,且目前没有提供一键部署包。该项目现阶段更适合技术团队研究架构方向,尚未达到商业生产环境的成熟度。

商业视角:流程优化的经济价值

在高阶视频模型计费昂贵的今天,依赖“盲试”的创作方式会导致极高的废片率,直接推高生产成本。

价值核心:成本控制

这类工作流工具的真正意义在于通过“编排”减少无效调用。如果参考图复用和分镜管理能顺利落地,将显著降低批量生产团队的试错成本。

这类工作流工具的真正意义在于通过“编排”减少无效调用。如果参考图复用和分镜管理能顺利落地,将显著降低批量生产团队的试错成本。

🚀 资源获取通道

免责声明: 本文介绍的 Jellyfish 项目仅供技术研究与架构探讨。该项目处于早期开发阶段,非成熟商业工具。使用时请遵守原作者开源协议,并确保调用的第三方 API(如 Kling、OpenAI 等)符合当地法律法规及服务条款。

正文完