如何在手机上实现完全离线的 3D 数字人交互?

在大多数 AI 交互应用中,语音识别、对话生成和画面渲染通常依赖云端服务器。这不仅带来了网络延迟,还引发了用户对隐私泄露的担忧。那么,是否能将一套完整的 3D 数字人系统直接运行在手机本地,且无需联网?

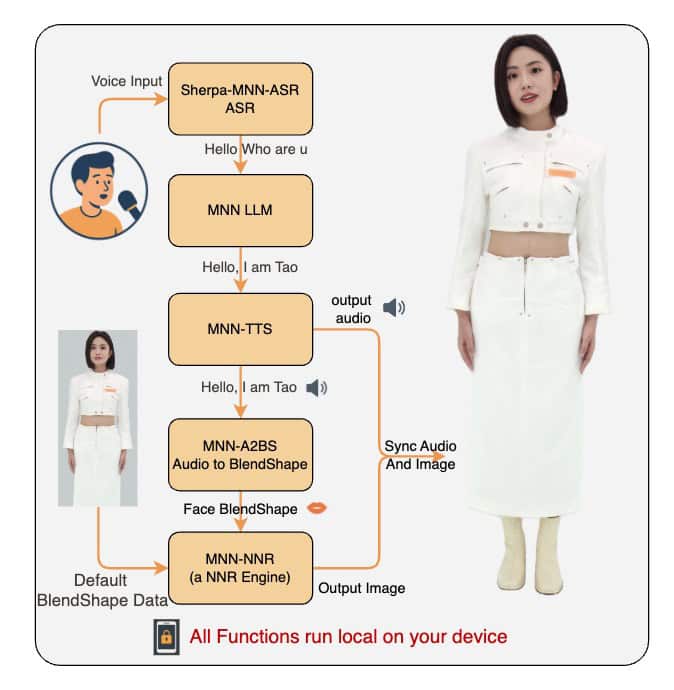

阿里巴巴开源的 MNN TaoAvatar 给出了肯定的答案。它基于 MNN 框架,将大语言模型(LLM)、语音识别(ASR)、语音合成(TTS)、声音驱动表情(A2BS)以及神经渲染(NNR)等多个复杂模块深度集成,让 Android 手机能够独立完成从“听”到“想”再到“演”的全流程多模态互动。

核心功能解析

MNN TaoAvatar 的核心在于将多种 AI 能力在端侧实现闭环,从而在保证隐私的同时提供流畅体验:

- 端侧自然对话:内置 LLM,无需联网即可实现实时聊天。

- 全链路语音处理:通过 ASR 将语音即时转为文字,再由 TTS 将回复转化为生动自然的语音输出。

- 动态表情联动:利用 A2BS 技术,数字人的面部表情与肢体动作会随声音起伏而实时变化。

- 高保真实时渲染:依托神经渲染技术,数字人的视觉表现更加细腻,交互感更强。

- 极致隐私保护:所有数据处理均在本地设备完成,彻底杜绝了数据上传云端的风险。

技术突破:如何让 3D 渲染在移动端起飞?

为了在资源受限的手机端实现高质量视觉效果,TaoAvatar 采用了前沿的 3D 高斯渲染(3D Gaussian Splatting)技术。其关键在于一套 教师–学生(teacher‑student)蒸馏策略:

研发团队将复杂的 StyleUnet 非刚性变形信息“烘焙”进轻量化的 MLP 网络中,并配合 blend-shape 补偿细节。这种优化让数字人不仅能在高端 AR 设备(如 Apple Vision Pro)上流畅运行,在移动端也能达到 90 FPS 的实时渲染速度,确保了视觉上的丝滑感。

适用场景

- 虚拟直播:打造无需服务器支撑的沉浸式 3D 电商主播。

- 全息通信:在远程协作中以自然的全身 3D 形象出现。

- AI 教育与陪聊:创建个性化的虚拟教师或情感陪伴角色。

- AR 增强现实:将数字人无缝融入 AR 应用,实现自然的面对面交互。

部署指南与硬件要求

由于涉及大量本地计算,建议设备满足以下硬件标准以确保流畅运行:

- 处理器:骁龙 8 Gen 3、天玑 9200 或更高规格的旗舰芯片。

- 内存与存储:8 GB RAM 及以上;预留至少 5 GB 存储空间用于存放模型。

- 架构:必须为 ARM64 架构。

注意: 配置较低的设备可能会出现画面卡顿、语音断续或部分功能无法开启的情况。

安装步骤:

- 克隆仓库:

git clone https://github.com/alibaba/MNN.git,随后进入apps/Android/Mnn3dAvatar目录。 - 使用 Android Studio 运行项目,或执行

./gradlew installDebug将应用部署至手机。

资源链接

下载地址:网盘下载

GitHub 地址:https://github.com/alibaba/MNN/tree/master/apps/Android/Mnn3dAvatar