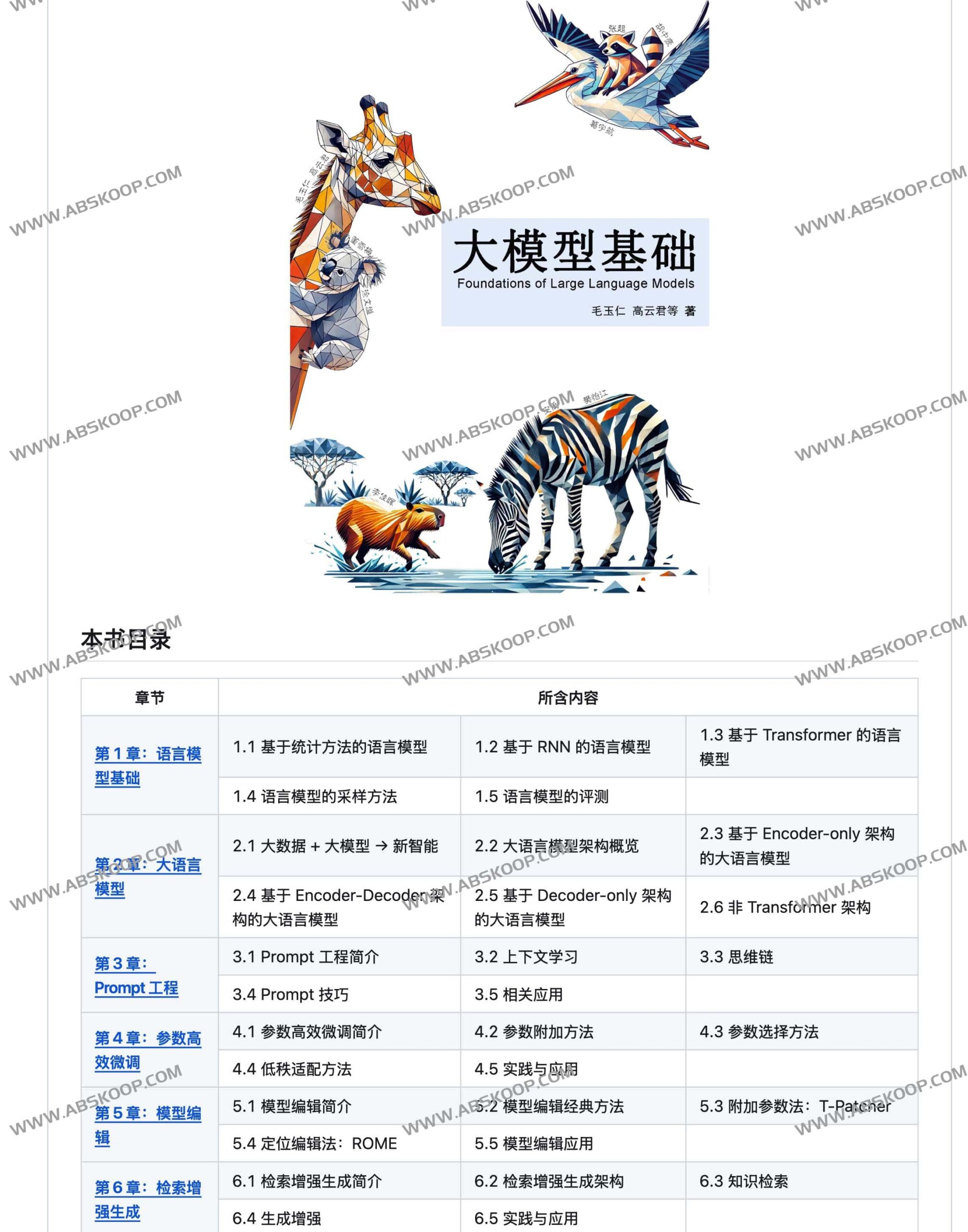

资源概览:大模型基础

《大模型基础》是一部旨在系统解析大语言模型(LLM)核心技术的专业指南。该资源不仅涵盖了从传统语言模型到 Transformer 架构演进的理论基础,还深入探讨了 Prompt 工程、参数高效微调(PEFT)等六大前沿领域。为了降低学习门槛,书中引入了动物案例来辅助理解复杂概念。

核心知识体系

- 基础架构: 详细解析统计方法、RNN 架构以及主流的 Decoder-only 模型。

- 实战技术: 深度剖析模型编辑、检索增强生成(RAG)及大模型评测方法。

- 优化方案: 提供低秩适配(LoRA)、T-Patcher 等实操方案,并探讨推理加速的预研方向。

- 应用构建: 指导开发者构建智能体(Agent)应用体系。

获取方式与适用环境

该项目在 GitHub 社区开放,提供完整的 PDF 资源下载及配套的章节论文清单。由于内容每月持续更新,建议通过仓库地址追踪最新的技术动态与智能体相关补充内容。

GitHub 地址: https://github.com/ZJU-LLMs/Foundations-of-LLMs

适用场景

本书适用于希望快速构建 LLM 知识体系的开发者、研究人员,以及需要将大模型技术落地到智能体应用场景的技术团队。无论是从零开始学习 Transformer 演进,还是寻求高效微调的实操方案,均可在此找到对应参考。

正文完